2025 年大语言模型年度回顾

内容

2025 年是大型语言模型(LLM)领域进展强劲且事件丰富的一年。以下是个人认为值得注意且略带惊讶的“范式转变”清单——这些转变改变了格局并从概念上吸引了我。

1. 基于可验证奖励的强化学习(RLVR)

2025 年初,大型语言模型生产栈在所有实验室中大致如下所示:

-

预训练(GPT-2/3,约 2020 年)

-

监督微调(InstructGPT,约 2022 年)和

-

基于人类反馈的强化学习(RLHF,约 2022 年)

这是训练生产级大型语言模型的稳定且成熟的配方。2025 年,基于可验证奖励的强化学习(RLVR)作为新的主要阶段被添加到这个混合中。通过在多个环境中(例如数学/代码谜题)训练大型语言模型以获得自动可验证的奖励,大型语言模型会自发地发展出类似于“推理”的策略——它们会学习将问题解决分解为中间计算,并学习一系列问题解决策略来解决问题(请参阅 DeepSeek R1 论文中的示例)。这些策略在以前的范式中很难实现,因为不清楚大型语言模型的最佳推理跟踪和恢复路径是什么——它必须通过优化奖励来找到有效的方法。

与监督微调和基于人类反馈的强化学习阶段不同,这两个阶段相对较薄/较短(计算上是微调),RLVR 涉及训练以客观(非可操纵)的奖励函数,这使得优化时间可以更长。运行 RLVR 被证明提供了高的能力/美元比率,这消耗了原本用于预训练的计算资源。因此,2025 年的大部分能力进步都是由大型语言模型实验室消化这个新阶段的过剩资源所定义的,我们看到类似大小的大型语言模型,但更长的强化学习运行。这个新阶段的另一个独特之处在于,我们获得了一个新的旋钮(和相关的缩放法则)来控制能力作为测试时间计算函数的增加“思考时间”。OpenAI o1(2024 年末)是第一个基于 RLVR 的模型的演示,但 o3 发布(2025 年初)是明显的转折点,你可以直观地感受到不同之处。

2. 鬼魂与动物/参差不齐的智力

2025 年是我(和我认为整个行业)第一次开始更直观地理解大型语言模型智力的“形状”。我们不是“进化/成长动物”,我们是“召唤鬼魂”。大型语言模型堆栈的一切都是不同的(神经架构、训练数据、训练算法,尤其是优化压力),所以我们得到非常不同的实体在智力空间中并不奇怪,这些实体不适合通过动物视角来思考。从监督的角度来看,人类神经网络是为部落在丛林中的生存而优化的,而大型语言模型神经网络是为模仿人类的文本、收集数学谜题中的奖励和从 LM Arena 中获得人类的点赞而优化的。随着可验证域允许 RLVR,大型语言模型在这些域附近“激增”能力,并且总体上显示出有趣的参差不齐的性能特征——它们同时是天才的博学家和困惑且认知受限的小学生,距离被诱骗到数据泄露只有几秒钟。

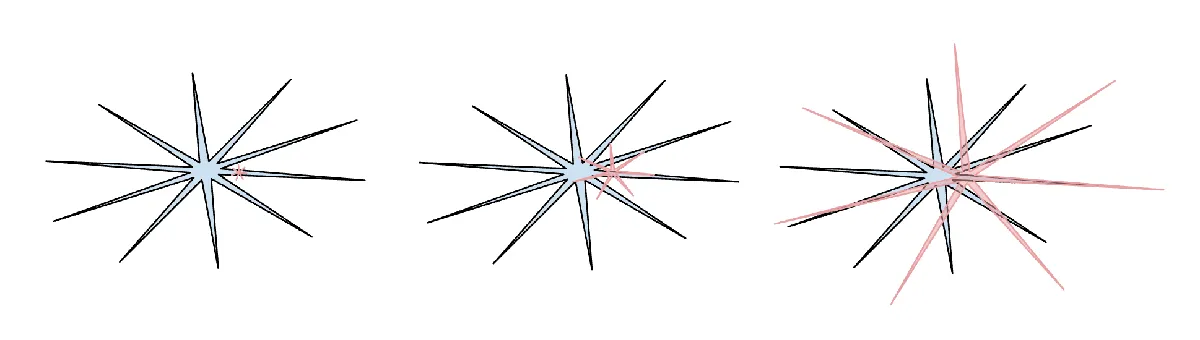

(人类智力:蓝色,AI 智力:红色。我喜欢这个版本的表情包(抱歉,我在 X 上丢失了原始帖子的引用),它指出人类智力也以自己的方式呈现出参差不齐的特征。)

(人类智力:蓝色,AI 智力:红色。我喜欢这个版本的表情包(抱歉,我在 X 上丢失了原始帖子的引用),它指出人类智力也以自己的方式呈现出参差不齐的特征。)

与所有这些相关的是我在 2025 年对基准测试的普遍冷漠和失去信任。核心问题是基准测试几乎是由构造可验证环境组成的,因此它们立即容易受到 RLVR 和通过合成数据生成的较弱形式的影响。在典型的基准测试最大化过程中,大型语言模型实验室中的团队不可避免地会构造出与基准测试相邻的环境,并发展出参差不齐的特征来覆盖它们。在测试集上进行训练是一种新的艺术形式。

什么样的情况下会压倒所有基准测试但仍然无法获得通用人工智能(AGI)?

我在以下文章中写了更多关于本节的内容:

3. 光标/新的大型语言模型应用层

我认为光标最值得注意的方面(除了它今年的迅速崛起)是它令人信服地揭示了一个新的“大型语言模型应用”层——人们开始谈论“光标用于 X”。正如我在今年的 Y Combinator 演讲中强调的那样(讲稿 和 ▶ 视频),像光标这样的大型语言模型应用将大型语言模型调用捆绑和编排到特定的垂直领域中:

-

它们执行“上下文工程”

-

它们在后台编排多个大型语言模型调用,形成越来越复杂的有向无环图(DAG),并在性能和成本之间进行仔细的权衡。

-

它们为环路中的人类提供特定于应用程序的图形用户界面

-

它们提供一个“自主滑块”

2025 年,有很多讨论集中在这个新应用层的“厚度”上。是否大型语言模型实验室会捕获所有应用程序,还是有绿色牧场供大型语言模型应用程序使用?我个人怀疑大型语言模型实验室将趋向于培养出一般能力强的大学生,但大型语言模型应用程序将通过提供私有数据、传感器、执行器和反馈循环来组织、微调和激活特定垂直领域中的团队。

4. Claude Code/生活在你的计算机上的 AI

Claude Code(CC)作为第一个令人信服的演示,展示了大型语言模型代理的样子——它以一种环路方式将工具使用和推理串联起来以进行扩展问题解决。另外,CC 值得注意的是它运行在你的计算机上,并且使用你的私人环境、数据和上下文。我认为 OpenAI 在早期的编码器/代理努力中犯了错误,因为他们专注于从 ChatGPT 编排的云部署容器,而不是简单地使用 localhost。虽然在云中运行的代理群感觉像“AGI 终局”,但我们生活在一个中间的、起飞较慢的参差不齐能力的世界中,在这种世界中,在开发者的计算机上运行代理更有意义。请注意,主要的区别不在于“AI 操作”发生的位置(在云中、局部或其他地方),而在于其他一切——已经存在并启动的计算机、其安装、上下文、数据、秘密、配置和低延迟交互。Anthropic 得出了正确的优先顺序,并将 CC 打包成一个令人愉悦的、最小的命令行界面形式,这改变了 AI 的外观——它不仅仅是一个你可以访问的网站,如 Google,它是一个小型的灵魂/鬼魂,生活在你的计算机上。这是一个与 AI 交互的新范式。

5. 氛围编码

2025 年是 AI 跨越了构建各种令人印象深刻的程序所需的能力阈值的年份,只需使用英语,并忘记代码的存在。有趣的是,我在 这个推文中 中创造了“氛围编码”的术语,完全不知道它会走多远:). 使用氛围编码,编程不再仅仅是高度训练的专业人员的专属领域,它是任何人都可以做的事情。在这种能力下,它是另一个例子,正如我在 赋予人民力量:大型语言模型如何颠覆技术扩散 中所写的那样,大型语言模型使普通人比专业人员、公司和政府受益更多。但是,氛围编码不仅使普通人能够接近编程,还使训练有素的专业人员能够编写大量原本不会编写的(氛围编码)软件。 在 nanochat 中,我使用氛围编码在 Rust 中编写了自己的自定义高效 BPE 分词器,而不是采用现有的库或以这种水平学习 Rust。我今年使用氛围编码编写了许多项目作为快速应用程序演示,展示了我想要存在的东西(例如,参见 menugen、llm-council、reader3、HN 时间胶囊)。我甚至使用氛围编码编写了整个短暂的应用程序,只是为了找到一个单一的 bug——为什么不呢?代码突然变得免费、短暂、可塑且在单次使用后可丢弃。氛围编码将改变软件并改变工作描述。

6. 纳米香蕉/大型语言模型 GUI

6. Nano banana / LLM 图形用户界面(GUI)

Google Gemini Nano banana 是 2025 年最令人难以置信、改变范式的模型之一。在我的世界观中,LLM(大型语言模型)是下一个主要的计算范式,类似于 1970 年代、80 年代等的计算机。因此,我们将看到类似的创新,出于同样的根本原因。我们将看到个人计算、微控制器(认知核心)、互联网(代理网络)等的等价物。特别是在 UIUX(用户体验)方面,“与 LLM 交谈”有点像在 1980 年代向计算机控制台发出命令。文本是计算机(和 LLM)的原始/首选数据表示形式,但它不是人们的首选格式,尤其是在输入方面。人们实际上不喜欢阅读文本 - 这很慢且耗费精力。相反,人们喜欢以视觉和空间方式消费信息,这就是为什么传统计算中发明了 GUI。同样,LLM 应该以我们喜欢的格式与我们交谈 - 以图像、信息图表、幻灯片、白板、动画/视频、Web 应用等形式。当然,早期和当前版本的这些技术包括 emoji 和 Markdown,它们是以标题、粗体、斜体、列表、表格等形式“装饰”和布局文本,以便于视觉消费。但是,谁将实际构建 LLM GUI?在这种世界观中,Nano banana 是对可能的外观的早期暗示。重要的是,其一个显著方面是,它不仅仅是关于图像生成本身,而是关于来自文本生成、图像生成和世界知识的联合能力,这些能力都交织在模型权重中。