内容

昨天早上,GitHub Copilot 用户终于确认了我一周前报道的那件事——所有 GitHub Copilot 套餐都将在 2026 年 6 月 1 日转向按使用量计费。

微软将不再按用户拥有多少“请求”来提供服务,而是根据用户实际使用模型的成本收费。微软称这“……是迈向可持续、可靠的 Copilot 业务与用户体验的重要一步。”用户将得到与其 GitHub Copilot 订阅费用等值的额度(例如:每月 19 美元套餐对应 19 美元的 token 额度)。

翻译一下:“我们没法继续补贴 GitHub Copilot 用户了,不然艾米·胡德(Amy Hood)就要拿棒球棍抽人了。”

总之,这则公告本身很有意思,因为它提前预演了这些价格调整将会如何被包装:

Copilot 已经不是一年前的那个产品了。它已经从编辑器内助手演变为一个具备代理能力的平台,能够运行长时间、多步骤的编码会话,使用最新模型,并在整个代码仓库范围内反复迭代。代理式使用正逐渐成为默认方式,而这会带来显著更高的算力与推理需求。如今,一个快速的聊天提问与一次长达数小时的自主编码会话,用户付出的费用却可能相同。GitHub 一直在承担这类使用背后不断攀升的大部分推理成本,但当前的高级请求模型已无法持续。按使用量计费可以解决这个问题。它能让定价更贴近实际使用情况,帮助我们维持长期服务可靠性,并减少对重度用户设置限制的需要。

你看,问题并不是微软一直在补贴将近两百万人的算力开销,而是AI 已经变得如此强大、如此复杂,几乎成了另一种产品!

虽然 Copilot 可能确实“……不是一年前的那个产品了”,但底层的经济错配几乎没变:微软在过去三年里,一直允许用户每个月消耗比订阅费更高价值的 token。据《华尔街日报》2023 年 10 月报道:

个人用户每月为这款 AI 助手支付 10 美元。据一位了解数据的人士称,在今年前几个月,该公司平均每位用户每月亏损超过 20 美元,而有些用户每月给公司带来的成本甚至高达 80 美元。

很自然地,GitHub Copilot 用户已经炸锅了,说这个产品“死了”“被彻底毁了”。

我推测,一场某种意义上的次级 AI 危机正在酝酿:几乎整个科技行业都押注在一种以极低折扣出售、由大型科技公司高度集中化并补贴的技术之上。某个时点,生成式 AI 惊人而有毒的烧钱速度终将反噬它们,进而导致价格上涨,或者企业推出收费极其苛刻的新产品和新功能——例如 Salesforce 的 “Agentforce” 产品那种离谱的每次对话 2 美元收费——让即便预算充足、向来坚定的企业客户,也无法为这笔开支找到合理性。

而那一天终于来了,因为你使用的每一项 AI 服务都在补贴算力,而且每一项服务都因此在亏钱:

当你为某个 AI 初创公司的服务付费时——当然,这也包括 OpenAI 和 Anthropic——你通常支付的是月费,比如 Anthropic 的 Claude、Perplexity 的月费 20 美元或 200 美元套餐,或者 OpenAI 的 8 美元、20 美元、200 美元订阅。在某些企业场景中,你会获得某种“积分”以对应特定工作单位,例如 Lovable 的 25 美元月费订阅提供“每月 100 积分”,以及 25 美元的云托管额度(到 2026 年第一季度末为止),且积分可跨月结转。当你使用这些服务时,相关公司会为所使用的 AI 模型支付接入费用,要么按每百万 token 的价格付给 AI 实验室,要么(对于 Anthropic 和 OpenAI 而言)付给为其出租运行模型所需 GPU 的云服务提供商。一个 token 大致相当于 3/4 个单词。作为用户,你感受不到 token 的消耗,你只会经历输入和输出的过程。AI 实验室通过“token”“消息”或带百分比刻度的 5 小时限额来模糊服务成本,而作为用户,你实际上并不知道这些东西究竟花了多少钱。在后端,AI 初创公司正在疯狂烧钱;直到不久前,Anthropic 还允许你每花 1 美元订阅费,最多烧掉超过 8 美元的算力成本。OpenAI 也差不多,只是很难判断具体高到什么程度。

AI 初创公司和超大规模云厂商(hyperscalers)原本以为,他们可以靠这些带补贴、亏本的产品先把足够多的人拉进门,让用户对服务形成依赖,等企业涨价时也不愿离开。我想他们还假设,token 成本会随着时间下降;然而现实却恰恰相反——尽管某些模型的价格可能有所下降,但新的“推理”模型会消耗更多 token,这意味着推理成本竟然随着时间推移变得更高了。

这两个假设都错了,因为按月订阅模式对于任何连接到大语言模型(LLM)的服务来说,都讲不通。

生成式 AI 的核心经济学已经坏掉了

你可以这样理解。Uber(对,而且这跟 Uber 完全不是一回事)开始提高车费时,其底层经济模型并没有变,乘客和司机面对的经济关系也没变——用户为一趟行程付费,司机因一趟行程获得报酬。司机仍然要支付汽油、车险、当地政府可能要求的各种许可费用,以及车辆相关的融资成本,而这些成本并不是由 Uber 补贴的。Uber 的巨额亏损主要来自补贴、无止境的营销支出,以及在自动驾驶汽车之类项目上注定失败的研发投入。

生成式 AI 订阅和 Uber 完全不一样

为了说明 AI 定价错配的规模,我想请你设想一个另类历史:Uber 拥有一种完全不同的商业模式。

生成式 AI 订阅就像这样:Uber 每月向用户收 20 美元,允许他们乘坐 100 次、每次距离不超过 100 英里的车;同时汽油价格是每加仑 150 美元,而且油钱由 Uber 来付,因为有人坚称石油总有一天会便宜到无需计量。

最终,Uber 会决定开始向用户收取进入平台的月费,然后再按其实际消耗的汽油收费。这样一来,用户就会从每月 20 美元坐 100 次车,突然变成花 20 美元获得叫车资格,再为一次 10 英里的行程支付 26 美元。可以理解,用户会有点不爽。

虽然这个比喻听起来有些夸张,但它其实相当准确地描述了生成式 AI 行业,尤其是 GitHub Copilot,正在发生的事情。

GitHub Copilot 之前的定价是每月允许 300 次高级请求,同时对 GPT-5 mini 这类模型提供“无限聊天请求”。这些请求中的每一次(借用微软的话)都是“……任何你要求 Copilot 为你做事的交互”,而在基于请求计费体系的后期,更贵的模型会消耗更多请求额度,例如 Claude Opus 4.6 会占用三个高级请求。高级请求用完后,Copilot 仍然允许你在当月剩余时间里不限量使用这些较便宜的模型。

甚至一直都不是这样。直到 2025 年 5 月之前,微软还给用户提供无限模型访问权限,而即便如此,用户当时也已经很愤怒,因为产品居然开始有了任何限制。

微软——和每一家 AI 公司一样——通过出售一种不可持续的服务来坑骗客户,因为按月订阅出售 LLM 驱动的服务,从一开始就根本、从来都不合理。

如果你在想,转向基于 token 的计费后服务大概会花多少钱,GitHub Copilot 子版块上的一位用户发现,过去一次高级请求的 token 消耗大约在 11 美元左右,因为一次“请求”会涉及上下文窗口中的 60,000 个 token、几个工具调用,以及一堆内部“轮次”(即模型为生成输出而进行的处理动作)。

还有一个问题是,容易产生幻觉的大语言模型本身就不可靠。高级请求原地打转、吐出半坏不坏的代码,固然令人沮丧;但当这些成本要你自己承担时,这种失误就没那么容易被原谅了。

而且,用户此前已经被训练成以一种完全不同于 token 计费的方式来使用这个产品,我猜其中很多人甚至根本不知道自己烧掉了多少“token”,也不知道某项任务会消耗多少,而这又会随着你所用模型的不同而变化。

这跟Uber 完全没有任何关系,任何告诉你两者类似的人,都是在替糟糕行为找借口。Uber 也许涨过价,但它并不需要彻底改变平台的底层经济结构,用户也不需要因为 Uber 突然改成按每加仑汽油收费,就完全改变自己使用产品的方式。

按月 AI 订阅本质上都是 AI 补贴骗局的一部分,是一种刻意让生成式 AI 与其真实成本脱钩的尝试

从来就不存在——以后也永远不会存在——一种在经济上可行、却又不按每个用户的实际 token 消耗收费的 LLM 服务模式。而在欺骗用户的过程中,这些公司造出了拥有虚幻收益、投资回报存疑的产品。

而且这一点,多年来一直明显得不能再明显。

从经济角度看,月度订阅只有在成本相对稳定时才说得通。健身房可以卖会员卡,因为它大致知道器械磨损有多大、课程运营成本多少,以及一定时间内电费、人力和水费大概是多少。

Google Workspace 的一个客户——至少在引入 AI 之前——对应的成本无非是访问或存储文档的费用,再加上 Google Docs 和其他服务的持续运营成本。数字存储本身成本较低(同时 Google Workspace 也不像 LLM 那样对计算资源要求极高),所以某个特别重度的 Google Drive 用户,并不会把自己月度订阅的利润空间吃掉。

相比之下,AI 订阅用户的成本可能会剧烈波动。有的用户可能只是偶尔拿 ChatGPT 搜索一下;另一些用户可能会灌进去成堆文档,或者试图重构一整个代码库,或者让它帮忙做一份 PowerPoint。对于服务提供方——无论是 OpenAI、Anthropic 这样的模型实验室,还是 Cursor 这样的初创公司——除了把产品变差之外,几乎没有什么真正办法去控制用户行为。所谓“变差”,包括设置使用上限、缩小上下文窗口、把客户推向更小(也更差)的模型,或者通过调整价格来劝退那些发起大规模、重 GPU 请求的用户。

然而,这些服务却刻意隐藏 token 数量,或者隐藏某项具体活动到底花了多少钱,这就导致用户根本不知道某个限额到底意味着什么,也意味着每一次突如其来的限额调整都会让客户慌忙摸索:我到底还能用这个服务做多少实际工作?

这是一种带有虐待性、操控性和欺骗性的商业方式,它之所以存在,只是为了让 Anthropic、OpenAI 以及其他 AI 公司扩大用户规模,因为大多数 AI 用户对这些服务真实或想象中的好处的认知,完全建立在自己可以用每 1 美元订阅费烧掉 8 到 13.5 美元 token 成本这一前提之上。

这种蓄意欺骗的目的只有一个:确保大多数人永远不会接触到生成式 AI 的真实成本。当《大西洋月刊》激情洋溢地把 Claude Code 吹成 Anthropic 的“ChatGPT 时刻”****时,它依据的是每月 20 美元的订阅体验,而不是 Anthropic 为提供该服务实际付出的底层 token 成本。也正因如此,作者才能轻易原谅模型犯下的“些许错误”,或者在“更复杂的编程任务上卡住”的情况。

如果这位作者支付的是自己真实的 token 消耗,而且每一次它“卡住”都对应 15 美元的 token 费用,我不觉得她还会对这些破事如此宽容。

但这正是骗局的一部分。

至关重要的一点是:主流媒体里写 AI 的人,最好根本不理解这些服务到底有多贵;所有关于 ChatGPT、Claude Code 之类服务的主流报道,最好都出自那些几乎不知道每项具体任务会给用户带来多少成本的人之手。

记住:生成式 AI 服务在很大程度上都是实验性产品,它们的工作方式与任何其他现代软件或硬件都不一样。你不能像操作普通软件那样,走到 ChatGPT 或 Claude 面前,直接让它开始干活。

我的意思是,你可以这么做,但如果你的提示词写得不对、不了解它的工作机制、输入内容出了错,或者它自己理解错了,它就会吐出你不想要的东西,然后你就得再提示它一次。LLM 从根本上就是不可预测的。

你无法保证某个 LLM 会不会执行某个特定动作,也无法保证它给你的结果一定符合现实。你也无法准确知道某项任务——即便是你过去已经用 LLM 做过很多次的任务——这一次究竟会花多少钱;同样你也无法确定模型何时会突然发疯、删掉某些东西,或者干脆什么都没做却声称自己做了。

如果你不是按 token 付费,这些问题就更容易被原谅,因为在订阅用户的心智里,这不过是和聊天机器人多来了一两轮对话,而不是在产生真实成本。人们不会太批评所谓“锯齿状智能”(jagged intelligence),因为默认的假设是:你现在遇到的这些问题,以后总会被解决的,反正你也没真为这些失误埋单。

如果用户从一开始就被迫按真实费率付费,我猜很多人会立刻对这产品失去兴趣,因为只要你随便折腾、探索一下 LLM 到底能做什么,烧掉 5 美元 token 实在太容易了。

顺带一提:实际上,你完全可能花掉一大笔钱,却依旧得不到你想要的结果,因为 LLM 根本就不是什么真正的人工智能!一个并不真正理解其局限性的人,很容易为了说服 LLM 去做一件它坚称自己“能做”的事,而烧掉 30 美元、50 美元、甚至 100 美元。这个现象有个词:谄媚性(sycophancy)。LLM 往往被设计成迎合用户,即便用户说的是危险且离谱的话,它也会附和;而这种附和也会延伸到“你想做这件技术上和财务上都根本不现实的大事?”当然没问题!这就是为什么整个行业如此努力地掩盖这些成本——这就是他妈的一个宰客局!

我认为,大多数 AI 订阅最终转向按 token 计费是不可避免的,尤其是Anthropic和 OpenAI 现在都已经对企业客户这么做了。

而微软把 GitHub Copilot 订阅用户也转向 token 计费,更是一个非常、非常糟糕的信号。微软大概是最有资本、最赚钱、也最有条件继续补贴算力的公司,如果连它都补不动了,那别人更不可能。

真正值得警惕的——一匹真正的苍马——将是像 Anthropic 或 OpenAI 这样的主要 AI 实验室把全部订阅用户都转到 token 计费。那一刻一旦到来,你就知道该打烊了。

普通公司负担得起转向 token 计费吗?Anthropic 估计用户在 Claude Code 上每天花 13 到 30 美元(每年 7000+ 美元),大型组织则一年花费数十万甚至数百万美元

正如我上周提到的,Uber 的 CTO 在一场会议上说,公司在几个月内就花光了整个 2026 年的 AI 预算,高盛则表示,一些公司在 AI token 上的支出高达人力成本的 10%,而且未来几个季度可能升至100%。

这正是把每一个 AI 用户都训练成尽可能多地使用这些服务、同时又刻意掩盖其真实成本的直接结果。每一家要求每一位员工“尽可能多地使用 AI”的大公司,都是在要么根本忽视、要么完全脱离实际 token 消耗认知的情况下这么做的。而随着企业被迫支付真实成本,我不确定你还能如何在经济上为对这项技术的任何投资找到合理性。

当然当然,你会说工程师“代码交付更快了”之类的鬼话,我懂,但问题是:到底快了多少?因此赚了多少钱、或者省了多少钱?如果你把人力成本的 10% 花在 AI token 上,这笔额外支出是否在别处得到了对冲?因为我不确定有。我不确定任何在 token 上砸下巨资的企业,真的看到了任何投资回报,这也是为什么几乎每一项关于 AI 投资回报率的研究都很难找到它确实存在的证据。

大体上,那些你读到的、对生成式 AI 无限可能兴奋不已的人,几乎都没有亲自承担过它的真实成本。每一个在 Twitter 上疯狂发长文、吹嘘整个工程团队都在猛用 Claude Code 的神经病,背后依赖的都是每人每月 125 美元的 Teams 订阅,其使用限制与 Anthropic 每月 100 美元的消费者订阅类似。每一个在 LinkedIn 上一本正经地说自己用某种 Perplexity 产品“几分钟干完几小时工作”的职场怪物,最多也不过是花了每月 200 美元订阅 Perplexity Max。

现实是,这个 10 人、每月 1250 美元的 Teams 订阅,很可能每个月在 API 调用上烧掉 5000 到 10000 美元,甚至更多。Anthropic 增长负责人 Amol Avasare 上周表示,其 Max 订阅本来是为重度聊天使用场景设计的,而不是现在人们拿 Claude Code 和 Cowork 在干的这些事;他还明确表示,Anthropic 正在考虑“不同的方案以继续提供良好体验”,换句话说就是:“我们迟早要改价格。”

我不确定人们到底有没有意识到这些 token 有多贵,尤其是那些涉及庞大代码库、并频繁调用编码工具和基础设施工具的编程项目。一个原本每月支付 200 美元的人,真的能承受 350、400 或 500 美元吗?他们能承受某个月花得比这还多吗?如果超预算了怎么办?如果他们根本无力支付完成工作所需的费用,又怎么办?

给你一个更实际的例子:直到 4 月初,Anthropic 自家的 Claude Code 开发者文档(存档)还写着:“[使用 Claude Code 的用户]平均成本为每位开发者每天 6 美元,90% 的用户日成本低于 12 美元。”而截至本周,文档已经改成这样:

Claude Code 按 API token 消耗收费。有关订阅套餐(Pro、Max、Team、Enterprise)价格,请参见 claude.com/pricing。每位开发者的成本会因模型选择、代码库规模以及使用模式(例如运行多个实例或自动化)而有很大差异。在企业部署中,平均成本约为每位开发者每个活跃工作日 13 美元、每月 150 至 250 美元,且 90% 用户的活跃工作日日成本低于 30 美元。若要估算你自己团队的支出,请先从一个小规模试点团队开始,并使用下方跟踪工具建立基线,再进行更大范围推广。

如果按一个月平均 21 个工作日来算,那么 Claude Code 用户的平均成本约为每月 273 美元,或者每年 3276 美元。若按每个工作日 30 美元计算,则相当于每月 630 美元,或每年 7560 美元。

这些数字惊人得离谱,尤其是考虑到一个事实:如果你使用 Anthropic 较新的模型,你根本不可能一天只花 30 美元。Claude Opus 4.7 的价格是每百万输入 token 5 美元、每百万输出 token 25 美元。‘一百万 token 大约相当于 5 万行代码,而如果你用的是那些号称最先进的模型,那你几乎不可能连至少一百万都用不到;如果你对不同任务该用哪个模型没什么概念,这个数字还会急剧上升。

我们再多玩一玩这个 30 美元的数字。

- 对一个 10 人开发团队来说,这就是每年 75,600 美元,而且我们只算工作日。

- 如果其中仅有三个月的平均值升到每个工作日 50 美元,这个数字就会上升到 88,200 美元。

- 如果再加上一个月你每天都超过 100 美元,那你一年就要花 102,900 美元。

- 如果你每天花 300 美元,那 10 个人一年在 token 上就是 756,000 美元。

对于融资充足的初创公司,或像 Meta 这样的“香蕉共和国”式企业,在那种预算松垮的思维下,这可能还说得过去;但任何真正关心成本的企业,要为一项“以某种没人说得清怎么量化的方式提高生产力”的服务,多掏五位数或六位数成本,都会遇到极大困难。

眼下,我觉得大多数公司大致分成三类:

- 像 Spotify 或 Uber 这样的大型组织中的企业级部署,CEO 已经完全被 AI 洗脑,预算任其失控。我觉得很多大型、资金充足的初创公司也属于这一类。

- 使用带补贴的 “Teams” 订阅的小型初创公司。

- 个人用户,按月付费使用 Claude 或其他 AI 订阅。

大型组织目前仍然可以轻描淡写地说,他们的软件工程师正在烧掉数百万美元的 AI token,而好处是他们那些“最优秀的工程师”不用写任何代码。

但只要一次糟糕的财报电话会,这种叙事就可能改变。某个时候,投资者——哪怕是那些把 AI 泡沫吹大的蠢货——也会开始质疑不断上涨的研发成本(AI token 消耗通常就被藏在这里),特别是在公司营收增长并未同步跟上的情况下。这很可能会导致更多裁员以对冲成本,Meta 就是如此;然后最终会有人问一句:“这些破玩意到底有没有真的让我们工作得更快或更好?”

我也认为,那些把 10% 或更多人力成本烧在 AI token 上的初创公司,六个月后会很难说服投资人相信这仍然是必要的。

而一旦所有人都切换到 token 计费,我不确定我们还会不会看到如今这么夸张的生成式 AI 热潮。

AI 数据中心与算力的经济学根本讲不通

如今人们谈论 AI 数据中心的方式,和现实完全脱节,我觉得很多人根本没有意识到这个时代到底荒唐到了什么程度。

AI 数据中心建设昂贵、运行昂贵,而实际收入却很有限

据 TD Cowen 的 Jerome Darling 说,数据中心每兆瓦容量大约需要 3000 万美元的关键 IT 投入(GPU 及相关硬件),外加 1400 万美元的数据中心容量成本。数据中心建设看起来通常需要一年到三年,具体取决于规模,而且这还得建立在电力供应可用的前提下。

号称到 2028 年底将建成的 114GW 数据中心中,真正以任何形式进入施工状态的只有 15.2GW。而“在建”甚至可能只意味着“地上挖了个坑”。这并不——也不应该——意味着该设施未来提供的容量很快就能投入使用。

题外话:如果你对这里更深层次的计算感兴趣,请订阅我的高级简报,这样你就能看到我的 Bastard Data Center Model,它是在多位分析师和超大规模云厂商消息源的协助下建立的。

我们先从简单的开始:每当你想到“100MW”,就把它理解成“44 亿美元”,其中很大一部分要花在 NVIDIA GPU 上。

因此,每一个 AI 数据中心从一开始就要先背上数百万美元的亏空,而且即便按六年折旧周期来算,也需要多年才能回本;而考虑到 NVIDIA 每年一次的升级周期,等你和第一个客户的合同跑完,这些 GPU 多半也已经赚不了多少钱了。

另外也不清楚,除了 OpenAI 和 Anthropic 之外,AI 算力到底有没有真正存在的客户基础。它们两家的需求占到了在建 AI 数据中心的 50%,这意味着如果其中任何一家没钱付款,整个系统都会暴露出巨大的脆弱性。

总之,这些数据中心到底按什么长期费率收费,也并不清楚。虽然 B200 GPU 的现货价格大概在每小时 4.50 美元左右,但长期合同通常便宜得多。一位创始人(据 The Information 报道)表示,他们为一份为期一年的承诺支付的价格大约是每块 GPU 每小时 3.70 美元。

需要说明的是,我们必须区分现货价格——也就是在别人服务器上临时启动 GPU 的价格——和签约算力,后者才构成了数据中心资本支出(capex)的主体。大多数数据中心建出来,本意都是为了服务一两个大客户,这意味着这些客户很可能会谈出更低的综合费率。

因此,很多数据中心实际收到的价格远低于每小时 3.70 美元,因为它们是按每兆瓦(或千瓦)计费的。

而这正是经济模型开始崩塌的地方。

一个 100MW 数据中心的破碎经济学——每小时 2.55 美元、100% 入驻率下毛利率 16%,但因为债务仍然不赚钱

这就是一个 100 兆瓦数据中心的起始成本。一个 100MW 数据中心,真正可计费的实际“设备”容量大概只有 85MW;根据与熟悉超大规模云厂商计费模式的消息人士交流,他们预计每兆瓦大约能带来 1250 万美元收入,也就是每年约 10.63 亿美元营收。

我需要说明的是,你所知道的大多数数据中心公司其实并不自己建设数据中心,而是把这项工作交给像 Applied Digital 这样的公司,它们也被称为“托管合作伙伴”(colocation partners)。例如,CoreWeave 向 Applied Digital 支付托管费用,以使用其位于北达科他州的数据中心。CoreWeave 负责数据中心内部所有 GPU 以及其他技术设备。

为了说明这种经济错配,我将使用一个理论上的例子:一个数据中心租给一家理论上的 AI 算力公司。

这个数据中心中的 GPU 很可能是 NVIDIA 的 Blackwell 芯片。更具体地说,数据中心很可能使用的是由 8 块 B200 GPU 构成的 pod,每个 pod 零售价约 45 万美元,也就是每块 GPU 56,250 美元。假设关键 IT 负载为 85MW,则每兆瓦的全部 IT 资本支出约为 3678 万美元,总 IT 资本支出约为 31.26 亿美元,其中仅 GPU 就大约 26.7 亿美元。

假设这个数据中心位于北达科他州的 Ellendale,当地工业电价大约是每千瓦时 6.31 美分,折合每年电费约 5540 万美元。根据与消息人士的交流,我估计维护、人力、电源更换等持续性成本大约占营收的 12%,也就是每年约 1.28 亿美元,这样一来,我们的成本就来到 1.834 亿美元。

等等,不对。你还得根据关键 IT 负载支付托管费用,而根据 Brightlio 的数据,这项费用通常约为每千瓦每月 180 到 200 美元,取决于部署规模和地点;不过我也见过低至 130 美元的数字,我这里就用这个数,也就是每年约 1.33 亿美元。这样总成本就来到 3.164 亿美元。

嗯,这还是低于 10.6 亿美元,所以看起来还行,对吧?

错!你有 31.26 亿美元的 IT 设备需要折旧,按六年折旧算,每年就是大约 5.21 亿美元。这样一来,每年成本合计就是 8.374 亿美元,最后只剩下约 1.686 亿美元年利润,毛利率大约 16.7%……

……*前提是你始终保持 100% 满租!*你看,数据中心把这些 GPU 装进去、再让客户真正入驻,往往要花上一两个月;在这段时间里,你的营收是零,但你仍然会持续亏钱,因为你还是得支付托管费、电费和运营开支,只是电费和托管/运营成本会稍低一些(我的模型按电费 10%、托管/运营成本 15%计算),这意味着你每天大约亏 327 万美元。

为了这个例子的方便,我们假设它额外花了一个月才真正投入运营,也就是说你已经付出了约 1.02 亿美元,而且这笔钱永远收不回来。这样加上折旧后,第一年的总成本就是 9.394 亿美元,毛利率只剩 6.6%。

等等,见鬼,你买这些 GPU 该不会还是借的钱吧?真借了?情况有多糟?哦天哪——你拿的是一笔 6 年期、贷款价值比 80% 的资产抵押贷款,也就是说你借了 28 亿美元,利率 6%。

银行出于它“永恒的慷慨”,给了你个优惠——前 12 个月只付利息……这大约就是 1.68 亿美元,于是我们第一年的总成本(为了公平起见,不算前面那一个月延误)就来到了约 10.05 亿美元……而你的收入只有 10.6 亿美元。

毛利率只有 5.19%,而且你甚至还没开始还本金。等你开始还的时候,每月贷款偿还额是 5410 万美元,接下来五年每年总共约 6.49 亿美元;这样算下来,总成本约 14.8 亿美元,毛利率大约变成负 40%。

而且我必须强调,这还是在你 100% 利用率、而且租户每一次都能准时付款的前提下。

Stargate 阿比林就是一场灾难——每块 GPU 每小时 2.94 美元、年收入 100 亿美元、进度落后多年、唯一租户每年亏损数十亿美元

我们来聊聊本该成为数据中心历史上经济可行性最高的项目——一个由甲骨文(Oracle)为全球最大 AI 公司打造的大型园区。甲骨文是家做了几十年的准超大规模云厂商,长期向企业和政府出售价格高昂的数据库和业务管理软件。

哈哈,我当然是在开玩笑,这地方简直就是他妈的噩梦。

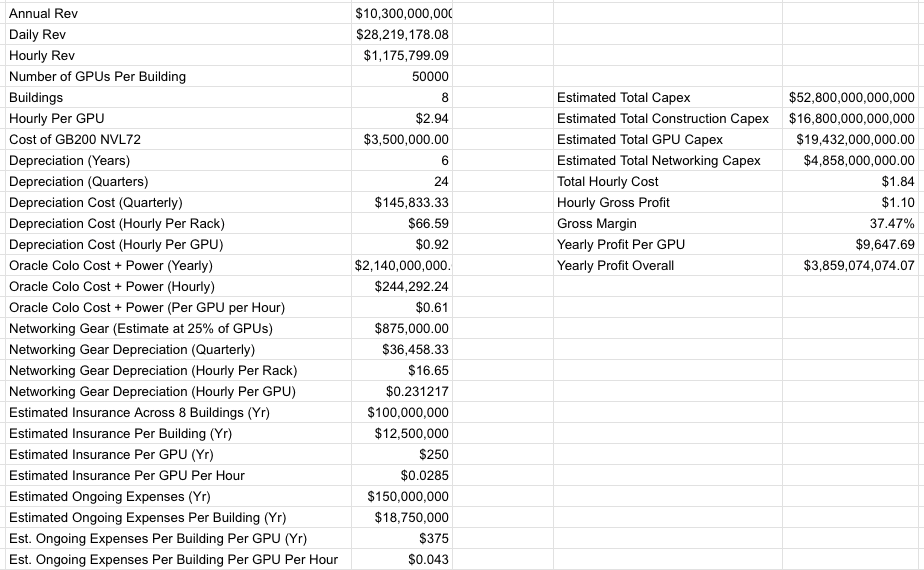

Stargate 阿比林是一个由八栋建筑组成、总容量 1.2GW、关键 IT 容量约 824MW 的数据中心园区,最早于 2024 年 7 月宣布。截至 2026 年 4 月 27 日,只有两栋建筑投入运营并产生收入,第三栋里甚至几乎还没多少 IT 设备。我估计 Stargate 阿比林的总成本大约为 528 亿美元。

根据我自己的报道,甲骨文预计 Stargate 阿比林每年可带来约 100 亿美元收入,而我估计它为单一客户 OpenAI 正在建设的 7.1GW 数据中心容量,总收入约为 750 亿美元。正如我也报道过的,甲骨文在 2024 年估计,阿比林每年至少要向土地开发商 Crusoe 支付 21.4 亿美元的托管与电费。

我还得补充一点:看起来阿比林的建设成本似乎全部由甲骨文承担。

基于我的计算和报道,我估计阿比林在完全投入运营后,粗略毛利率约为 37.47%:

我必须说明,这个 37.47% 的毛利率很可能偏高,因为我并不准确掌握甲骨文真实的保险或人力成本,只能依据本刊看到的文件做估算。我还必须说明,甲骨文正把自己整个他妈的未来押在像 Stargate 阿比林这样的项目上,提前承担数十亿美元成本,押注于一项即便 OpenAI 每一笔钱都能按时支付、也要很多年后才能盈利的业务。

我必须说明,这个 37.47% 的毛利率很可能偏高,因为我并不准确掌握甲骨文真实的保险或人力成本,只能依据本刊看到的文件做估算。我还必须说明,甲骨文正把自己整个他妈的未来押在像 Stargate 阿比林这样的项目上,提前承担数十亿美元成本,押注于一项即便 OpenAI 每一笔钱都能按时支付、也要很多年后才能盈利的业务。

遗憾的是,我无法判断阿比林有多少建设成本是通过债务支付的,只知道甲骨文在 2025 年 9 月发行了大约 180 亿美元、不同期限的债券,到期期限从 7 年到 40 年不等,而且在最近一个季度财报中其现金流为负 247 亿美元。

我知道的是,它与开发商 Crusoe 签有一份 15 年租约,而甲骨文的未来极大程度上取决于 OpenAI 是否有能力持续付款,而 OpenAI 能否持续付款,又取决于甲骨文能否完成 Stargate 阿比林。

我还需要说明的是,那每年 38.5 亿美元的利润,只有在 OpenAI 按时付款、尽可能快地接管阿比林的容量、并且一切都按计划推进的情况下才有可能实现。

如果 OpenAI 在未来 4 年内无法筹到 8520 亿美元的营收、融资和债务,Stargate 数据中心项目会拖死甲骨文

遗憾的是,现实完全相反:

根据 DatacenterDynamics 的报道,最初这 200MW 电力本应“在 2025 年通电”。随着时间推移,入住原计划在 2025 年上半年开始,曾被称“有可能在 2025 年达到 1GW”,曾计划在 2026 年年中完成全部 1.2GW 容量、于 2026 年年中通电,并在 2026 年底前部署 64,000 块 GPU。截至 2025 年 9 月 30 日,据称“已有两栋楼上线”;截至 2025 年 12 月 12 日,甲骨文联席 CEO Clay Magouyurk 表示阿比林“进展顺利”,且“已有超过 96,000 块 NVIDIA Grace Blackwell GB200 交付”,也就是大约两栋楼对应的 GPU 数量。四个月后的 2026 年 4 月 22 日,甲骨文发推称:“……在阿比林,200MW 已经投入运营,八栋建筑园区的交付仍按计划进行。”但这 200MW 究竟指关键 IT 容量还是阿比林园区的总可用电力并不明确;无论如何,这都只够两栋建筑使用,也就是说,甲骨文绝对称不上“按计划推进”。

这是个大问题。OpenAI 只能为实际存在的算力付费,而真正产生收入的关键 IT 容量只有 206MW,第三栋楼至少还要一个月(如果不是一个季度)才能开始挣钱。

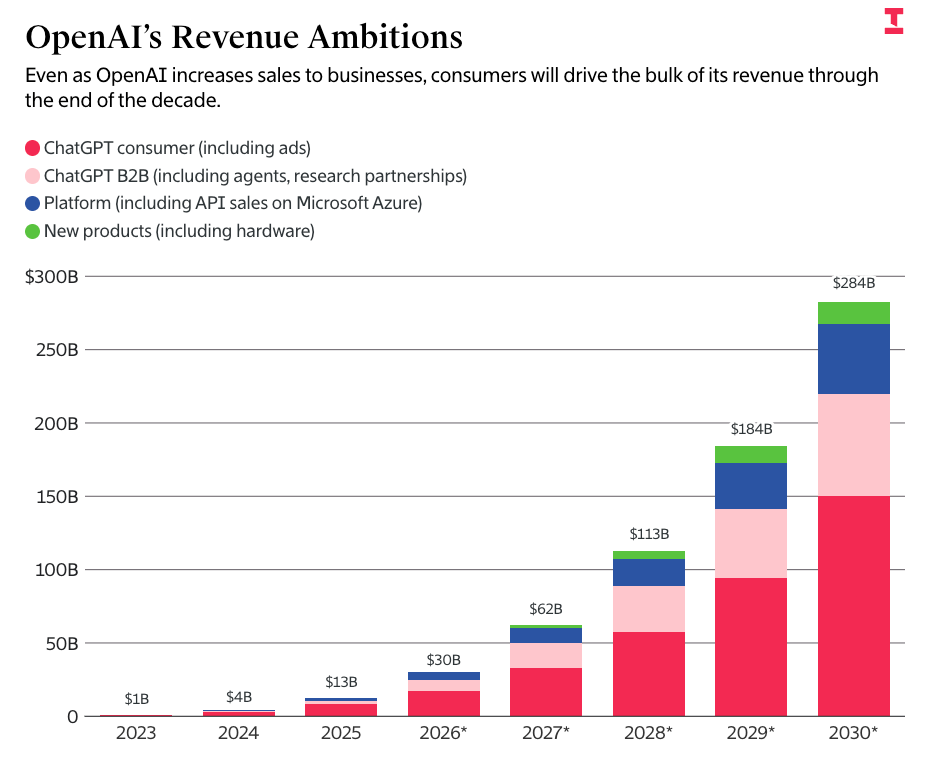

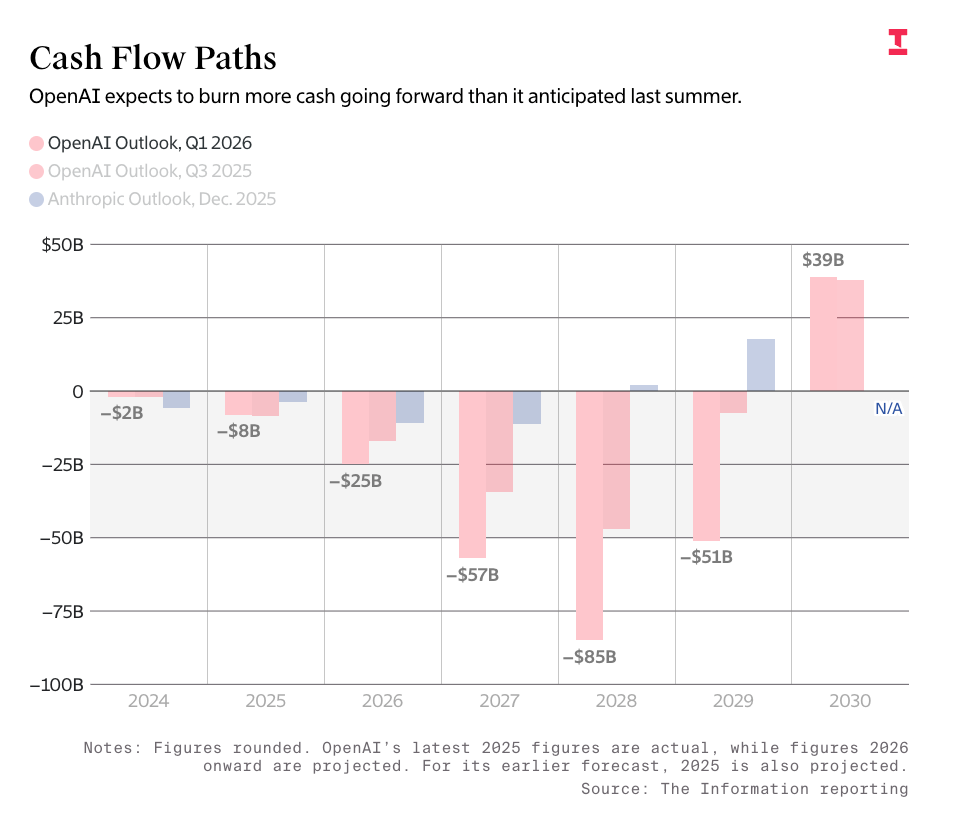

但整个 Stargate 数据中心项目还有一个更大、也更具生存威胁的问题——它成立的唯一前提,是 OpenAI 必须实现那些荒唐、漫画般夸张的预测。

我再重复一遍这些数字:正在推进中的 7.1GW Stargate 数据中心,建成后每年将带来约 750 亿美元收入,总成本将超过 3400 亿美元。甲骨文自由现金流为负 247 亿美元,其他业务线增长趋平,使得其负利润到低利润率的云业务成了唯一增长引擎。为了真正支付其算力协议——包括对 Amazon、Microsoft、CoreWeave、Google、Cerberas 以及甲骨文等合作方的付款——OpenAI 必须在四年内筹集或赚到 8520 亿美元的营收和/或融资,这要求其业务每年增长超过 250%,到 2030 年底等于增长近 10 倍,并且届时还必须找到办法实现现金流转正,这样这些数字才说得过去。说白了,OpenAI 自己的预测是未来四年营收 6730 亿美元,但为此要烧掉 2180 亿美元。它是一家极度不盈利的公司,而即便不是,它也必须赚到比现在多得多的钱,才能持续向甲骨文付款。

我之所以算出 750 亿美元这个数,是基于这样一个假设:我预计剩余 Stargate 数据中心将由约 4.64GW 的关键 IT 构成,而 Vera Rubin GPU 每兆瓦算力大约能带来 1400 万美元收入(这一数字我已向熟悉数据中心行业的消息人士核实)。

OpenAI 的数字则直接来自The Information 披露的 OpenAI 预计烧钱速度和营收预测,该预测显示,公司到 2030 年底前将实现 6730 亿美元营收,并为此烧掉 8520 亿美元:

我必须说明,任何记者如果复述这些数字时不顺带说一句它们有多他妈愚蠢,都应该感到有点羞愧。根据我周五的高级简报:

我必须说明,任何记者如果复述这些数字时不顺带说一句它们有多他妈愚蠢,都应该感到有点羞愧。根据我周五的高级简报:

换句话说,两年后 OpenAI 预计其营收将超过台积电(TSMC);三年后,年营收将接近 Meta;到 2030 年底,其年营收将与微软相当(过去 12 个月口径下大约 3000 亿美元)。

而如果 OpenAI 付不起这些算力费用,甲骨文就得死,因为它仅仅为了建设 Stargate 数据中心就已经承担了大约 1150 亿美元债务,而且还需要再筹至少 1500 亿美元才能完工:

甲骨文目前每年营收大约 640 亿美元,而上个季度自由现金流为负 247 亿美元。它在 2025 年 9 月发行了 180 亿美元债券,在 2026 年 2 月又发行了 250 亿美元债券,3 月某个时候还做了一笔 200 亿美元的市价增发;而尽管有关项目数月来都说“已完成”,它似乎直到最近才真正完成了 Stargate Wisconsin 和 Shackelford 的 380 亿美元项目融资。我还把与 Stargate Michigan 相关的 140 亿美元数据中心债务算进去了。无论如何,甲骨文都没有足够资本完成 Stargate 阿比林。它至少还需要再筹 1500 亿美元,而且这还是假设其他合作方分担大约 300 亿美元成本的前提下。说实话,可能还不止。

我真的必须说清楚:没有 OpenAI,甲骨文根本没有别的路径来获得这笔收入,而这些项目完全是依赖数据中心自身未来预期现金流来融资和偿付的。

而且担心这件事的不只我一个,OpenAI 的 Sarah Friar 在公司未达成用户与营收目标后,也表达了类似担忧,据《华尔街日报》报道:

OpenAI 最近未达到其自身关于新增用户和营收的目标,这些失误让公司一些领导层开始担心其是否有能力支撑在数据中心上的巨额支出。据知情人士称,首席财务官 Sarah Friar 已告诉其他公司领导,她担心如果营收增长不够快,公司可能无法支付未来的算力合同。董事会成员近几个月也更加仔细地审视了公司的数据中心协议,并质疑首席执行官 Sam Altman 在业务放缓的情况下,仍试图获取更多算力的做法。

如果这还不够让你担心,那再看看这个:

她向高管和董事会成员强调,OpenAI 需要改善内部控制,并警告称,公司目前尚未准备好满足上市公司所需的严格报告标准。据一些知情人士称,Altman 更倾向于推进一个更激进的 IPO 时间表。

这听起来可真像一家能在本十年结束前赚到 8520 亿美元的公司啊!

Anthropic 和 OpenAI 一样糟糕,承诺从 Google 和 Amazon 获得最多 10GW(年收入 1000 亿美元以上)的算力

虽然我经常吐槽 OpenAI 的荒唐承诺,但 Anthropic 也没差太远。它承诺将从Google和Amazon那里分别获取“最多”5GW 的容量;按这个规模,我估计其中实际算力承诺价值大约在 1000 亿美元左右。

现在,我得补充一点:Google 和 Amazon 显然比甲骨文精明得多,也没那么绝望,这意味着如果 Anthropic 最后没钱了,它们承受得住这一下。而这笔协议中的“最多”二字,也给了它们一些甲骨文完全没有的回旋空间。

尽管如此,要真正兑现这些承诺,到 2030 年底,Anthropic 仍必须同意每年在算力上花费 250 亿到 1000 亿美元。

Anthropic 的 CFO 在 3 月表示,公司成立至今总共实现了 50 亿美元营收。

要支撑在建的 15.2GW AI 数据中心,每年需要 1568 亿美元 AI 算力收入;要支撑全部已宣布的 114GW,则需要 1.18 万亿美元

人们对黄仁勋声称不断卖出数千亿美元 GPU 这件事所表现出的近乎色情般的兴奋,往往掩盖了一个麻烦的问题:黄仁勋,这些算力到底是要卖给谁?

如果我们假设到 2028 年底前完工的 15.2GW 数据中心容量,其 PUE 大约为 1.35,那么真正对应的关键 IT 容量大约是 11.2GW。按每兆瓦 1400 万美元计算,这意味着每年大约需要 1568 亿美元的 GPU 租赁收入,才能让这些数据中心真正值回票价。

如果你把理论上将在 2028 年底前上线的全部 114GW 容量算进去,这个数字会攀升到每年 1.18 万亿美元。

给你一点参照:CoreWeave——这家最大的“新云厂商”,客户包括 Meta、OpenAI、Google(代表 OpenAI)、Microsoft(代表 OpenAI)、Anthropic 和 NVIDIA——📚大约实现了 51 亿美元营收,并且预测 2026 年营收将达到 120 亿到 130 亿美元。

那么,到底是谁会成为这些算力的客户?而等到这些容量真的全部建成时,他们又有多大可能还愿意买?虽然很多不同的数据中心都声称,在建成后的头几年已经有租户预定,但这些租户只有在数据中心真正完工后才会开始付款;而如果租户本身是 AI 初创公司,那么问一句“等它建好时,这家公司还在不在?”其实非常合理。

记住:AI 算力的客户,大部分要么是想把资本支出移出资产负债表的超大规模云厂商,要么是亏损中的 AI 初创公司。Anthropic 和 OpenAI 都计划在未来几年烧掉数百亿美元,而且两家公司都看不到盈利路径。

这意味着,AI 算力收入中很大一部分——如果不是大多数的话——都依赖于风险资本和债务的持续流入,而这两者之所以还能流动,只是因为投资者仍然相信生成式 AI 会成为世界上最大、最伟大、最不得了的东西。

可这到底是怎么运转的?究竟是谁在为这些数据中心容量买单?这些容量到底是给谁准备的?真实需求到底在哪里?

而如果这种需求真的存在,这些客户他妈又怎么付得起钱?

生成式 AI 既不盈利,也不可持续,而且只会越来越贵

尽管有多篇 报道称 OpenAI 和 Anthropic 都将在 2028 或 2029 年实现盈利,但没有人能向我解释,OpenAI 或 Anthropic 到底怎么才能真正盈利,尤其是在两家公司的利润率都比预期更糟的情况下——而且这些利润率甚至已经剔除了高达数十亿美元的训练成本。

而这个问题我他妈已经问了很多年。每次 Anthropic 或 OpenAI 出来一个新动态,我们听到的都是:亏损比预期更多,利润率在恶化,成本在飙升,一切都更贵了,尽管他们之前承诺的明明是字面意义上的相反。

就连 Cursor,这家公司曾短暂宣称自己(在被马斯克的 SpaceX 伪收购之前)拥有正毛利率,实际上截至 1 月它的毛利率是负 23%,*如果把非付费用户的成本也算进去,那就是负 31%;而如果你真的在乎会计,这部分当然就该算进去。*很神奇的是,报道声称 Cursor 的利润率“最近转正了”,却神奇地不知道具体转正了多少、是怎么转的,或者其他任何细节,只知道这一点大概刚好足以帮助它顺利卖身。

我也看不出这些 AI 数据中心到底怎么讲得通,即便前几年确实有客户愿意付钱。它们的经济模型是为“完美状况”打造的,几乎没有任何容错空间。它们必须保持持续、100% 的利用率和租用率,否则就会每天烧掉数百万美元,而且根本撼不动由科技行业史上最昂贵错误所堆出的那道多年折旧高墙。

即便它们 somehow 真成功了,这些也不过是利润率平庸得可怜的生意——最好情况也不过 70%,而这还得建立在持续付款、持续租用、以及他妈整整六年的折旧周期才能真正回本的前提下;考虑到年度升级周期会让整个系统在你还没还完钱前就接近过时,这本身都已经很难了。

而这还没算上,它们的大多数客户本身就是不盈利、不可持续的初创公司。

我真不知道这一切最终要怎么收场。

LLM 就是一场宰客,而客户一直在被欺骗

我知道这听起来可能有点重,但我真心认为,基于订阅的 AI 服务本身就是一种近乎欺诈的欺骗行为,因为它们歪曲了核心单位经济学,也因此歪曲了大语言模型的真实可能性。通过按月费把产品卖给用户,并基于这种可得性塑造用户习惯,Anthropic、OpenAI 这样的公司以一种扭曲自己业务本质的方式误导了用户,结果就是:绝大多数用户如今正在与一类不可持续、无法以当前形式维持下去的产品互动,并围绕这些产品构建工作流。

Anthropic 最近激进的限额调整,是在它刚做完多轮激进营销活动后短短几个月内推出的,而这些营销所描绘的体验,在当前限额下几乎已经不可能实现了。并且从 Anthropic 最近的动作来看,很明显它打算在未来某个时候开始砍掉面向每月 20 美元低端订阅用户的服务。这种经营方式既恶心又误导,而 Anthropic 在谈论其产品和服务时的含糊其辞,是对所有用户的侮辱,也说明它根本不怕媒体。

我必须非常明确地说,鉴于最近的限额变化,Anthropic 当前提供的产品,与那些你在到处读到的版本相比,已经有了实质性不同——而且糟糕得多。Anthropic 明知如此,仍然刻意营销一个自己知道三个月内就会消失的产品。只要媒体还在替 Dario Amodei 写今天又凭空变出多少年化营收、或者他又发布了什么新产品去摧毁某家可怜上市 SaaS 公司——哪怕那家公司其实本来增长就已经放缓——他才根本不在乎。

各位媒体朋友,我怀着极大的尊重说这句话:Anthropic 正在糟践它的客户,而它之所以敢这么做,是因为它觉得自己可以全身而退。这家公司并不尊重你,事实上它对你怀有惊人的轻蔑,这也是为什么它根本懒得迅速修好自己的服务,或者用任何有条理的方式解释服务为什么会坏掉。

这就是为什么 Anthropic 会公然撒谎,说 Claude Mythos 因为太强大而无法发布(实际上是容量问题),而事实上它不过又是一个他妈的大语言模型空心糖——因为它知道你会买单,知道该怎么包装才能给你足够多看似可信的“证据”,让你和你的编辑匆匆扫一眼 system card 后,就信了自己正在写的那套说法。

它们也知道你会抢着报道,而不是等真正的专家先发声。

AI 是一场骗局,而这就是骗局的运作方式。AI 被以人类所能做到的最快速度、以最低效却最易接触的形式塞到我们脸上,哪怕这种形式从一开始就不可能导向任何近似可持续的商业模式。媒体被迅速推着去立刻宣布:这就是那个东西,这样所有人就都会认定:现在它就是那个东西了,然后尽可能多地去使用它。而最关键的是,要让人们以订阅制的形式去使用它,从而在体验它时永远不去问:提供这项服务到底要花多少钱。

整套叙事在一开始就已经预制好了。因为真正讨论过 LLM 的人里,很少有人亲身感受过它的真实成本,所以他们模糊地说一句“这就像 Uber”会非常容易,因为 Uber 也是一家烧了很多钱但没死的公司;说这个,当然比说“等等,你是说 OpenAI 今年要亏 50 亿美元?”要简单多了。

你可以这么想:作为记者、投资人、高管,或者普通的 LinkedIn 办公室油腻精,你可能零零碎碎看过一些信息,说输入 token 是每百万 5 美元、输出 token 是每百万 25 美元,但你从未真正体验过这笔钱烧起来到底有多快——而想真正理解这种产品,这种体验非常重要。Anthropic 和 OpenAI 刻意模糊了这种体验,建立起一种预计在 2026 年烧掉数百亿美元、到 2030 年烧掉数千亿美元的业务,仅仅因为大多数人评估生成式 AI 时,依据的都是订阅制体验。

LLM 就像赌场,而你一直是在拿庄家的钱下注,同时又鼓动别人用自己的钱去赌:某个模型到底能不能给出一个可用的工作成果。

这一切都是故意的。他们从来就不想让你去思考成本,因为一旦你真的开始思考成本,*整件事就会显得有点疯。*我真心相信,基于 LLM 的订阅模式将会彻底消失,至少对于任何能够生成代码的产品来说会如此;而在这个过程中,Amodei 和 Altman 会觉得自己终于把这场骗局收尾了,或者至少自以为如此。

问题在于,这些人现在已经签下了太多协议,根本不可能毫发无伤地脱身。

OpenAI 的 CFO 现在已经多次 表示,她不认为 OpenAI 已经准备好 IPO,并且对其增长前景和持续履约能力有实质性担忧。再重复一下前面的引文:

据知情人士称,首席财务官 Sarah Friar 已告诉其他公司领导,她担心如果营收增长不够快,公司可能无法支付未来的算力合同。

这就是一个他妈不断闪烁的红色警报。在一个正常市场里,这足以让甲骨文股价暴跌,因为*OpenAI 必须把年营收冲到超过 2800 亿美元,甲骨文才有可能不把钱烧光。*在一个正常媒体环境里,这会在每一个群聊和 Slack 频道里引发令人不安的震荡,大家都会开始认真讨论:OpenAI 到底还能不能撑下去。

这种事,往往发生在一家公司开始走向死亡之前。OpenAI 的增长正在放缓,而偏偏此刻它最需要的是加速增长。到 2030 年,它必须把现有业务规模扩大近 10 倍,才能履行自己的义务。**OpenAI 的 CFO——字面意义上最清楚情况的人——正在说:如果营收不增长,她担心 OpenAI 连他妈的算力合同都付不起。**这就是一个巨大的、不断闪烁的警示灯!这不是演习!

可真正让我极度不安的,是《华尔街日报》提到 Friar 认为 OpenAI“尚未准备好满足上市公司所需的严格报告标准”。

*这他妈是什么意思?*不好意思?这家公司据称已融资 1220 亿美元、估值据称高达 8520 亿美元,并且预计到 2030 年底要烧掉 *8520 亿美元。*它的账目还没理顺吗?OpenAI 到底满足不了什么“严格报告标准”?

一般来说,如果不是因为这家公司在去年大概占了所有风投融资的 20%,并且我走到哪都得听 Sam Altman、Greg Brockman 以及 OpenAI 其他男人们没完没了地夸夸其谈、告诉普通人应该怎么做,同时自己却在到处发布垃圾软件、挥霍别人的钱,我也不会这么他妈多管闲事。

考虑到 Anthropic 和 OpenAI 占据了如此多的公共注意力,这两家公司理应在产品和商业层面都无可挑剔。然而现实却是,两家公司都通过对其经济模型和有效性的不同程度欺骗来推销自己,掩盖真相,好让他们的 CEO 积累金钱、权力和关注度。这是对好软件和好品味的双重侮辱——史上最贵、最不可靠的一类应用,它们的错误被原谅,它们的平庸被赞美,它们的基础设施被奉为一尊资本的惰性神像。

生成式 AI 就是一种侮辱。它不可靠,它的经济学毫无道理,它的结果不足以证明其存在合理性,而这场骗局的操盘者不过是一群无聊、笨拙、贪婪的男人,他们与社会、以及任何可能反对他们的人都彻底脱节。它要求从所有人那里偷艺术作品,破坏环境,抬高我们的电费,持续制造经济毁灭的威胁,还伴随着无穷无尽的“现在一切都因为 AI 变得更烂了”的噪音,只为了推动一种只有在无视最基本金融常识或理智的前提下才说得过去的软件。

这一切都贵得离谱,而这一切又他妈无聊得要命。它无礼地无聊。它令人烦躁。每一篇有人告诉你自己有多依赖 AI 的故事,听起来都像是在描述一段虐待关系,或者某人加入了邪教,话语里带着一种微妙的绝望:“你真的得加入我,因为它太好了,而我从这个产品里看起来完全感受不到快乐,这恰恰说明它多么高效。”AI 能做的事情里,没有任何东西是轻松愉快的。大语言模型没有任何滑稽、奇趣、令人会心一笑的地方,每一次交互都显得空洞。

那些拼命寻找它正在变得有知觉、或者“更强大”的迹象的人,其实只是自己在寻求认同——他们想要成为第一个看到某件事的人,因为得出别人早晚也会得出的结论,本来就是他们的职业习惯。

“抢在前面”——或者说站在所谓“前沿”——是那些内心找不到东西的人格外渴望的状态,而这恰恰也是骗子最爱利用的燃料,因为 LLM 总会持续发出一种它马上要做出新东西的嗡鸣感,尽管它在数学上注定只能重复已有行为。

这是一个极其悲哀的时代。那些如此激进地联手托举这个行业的人,只不过是在推迟它不可避免的坠落。让我感到恐惧的是,我们的市场乃至部分经济,居然建立在一种普遍被相信、却完全没有被证明的假设之上:LLM 总会变便宜,AI 初创公司会神奇地实现盈利,而提供 AI 算力会永远赚钱,赚钱到足以合理化在 2030 年前把当前供给扩大十倍。

人们为了替 AI 行业辩护,已经把自己作践到了可笑的地步,因为行业就是这么要求它的朝圣者的。想成为“AI 专家”,就必须主动无视历史上任何行业中最糟糕的经济学,必须不断替产品中明摆着、刺眼到不行的问题开脱,还得积极说服别人也这么做。OpenAI 和 Anthropic 之所以不清楚说明自己将如何盈利,是因为它们知道自己的支持者永远不会追问——因为要想彻底“相信 AI”,唯一的办法就是主动给自己戴上眼罩。

而我明白。如果你接受了 OpenAI 和/或 Anthropic 最终会崩塌这个前提,那这一切看起来就会有点疯狂。我是真诚地请你认真考虑:这两家公司中的一家,甚至两家,都可能会把钱烧光。

我真的很担心,而让我更担心的是,我在媒体和整个社会中看到的普遍缺乏忧虑。

如果非要猜的话,大家的默认假设大概是:我只是在危言耸听,而“需求肯定绝对会在那里”。

你最好希望自己是对的。

至少,为了 Larry Ellison 的利益也得如此。Ellison 已经质押了 3.46 亿股甲骨文股票——约合 615 亿美元——“以担保某些个人债务,包括多项信贷额度”,说白了就是“拿自己的甲骨文股票去做了很多又大又漂亮的贷款”。IFR 在 9 月估计(那时甲骨文股价高得多),按 20% 的贷款价值比(他们称之为“保守”)计算,这些股票最多可以为他撬出 214 亿美元债务,前提还得是银行没特别慷慨。

如果 OpenAI 到 2030 年底无法筹集到 8520 亿美元营收和融资,它就付不起 Stargate。那会直接砸烂甲骨文股票的价值,引发一连串追加保证金通知,迫使 Ellison 抛售股票,再引发更多追加保证金。无论到时候是否会有某种纾困,都救不了 Larry 的家业。

我想说的是,Ellison 的未来,正押注在 Sam Altman 能否在 4 年内筹到并赚到 8520 亿美元。

祝你好运,Larry!你会非常需要它。