内容

引言

今天,我们正式发布 Ling-2.6-flash 的开源版本。这是一个指令模型(instruct model),总参数量为 104B,激活参数量为 7.4B。

随着智能体(agent)能力的不断成熟,Token 消耗量的急剧上升已成为部署的主要障碍。与标准对话不同,智能体工作流涉及大量输入和复杂的多步执行,这不仅推高了计算需求,也显著增加了用户成本。尽管业界正转向“长推理(long-reasoning)”以突破性能上限,但一个关键问题依然存在:对于高频、日常的智能体应用场景,这些额外的推理 Token 是否真的必要?

面对日益增长的 Token 压力,Ling-2.6-flash 另辟蹊径。它没有依赖更长的输出来追求更高的分数,而是系统地针对推理效率、Token 效率和智能体性能进行了优化,旨在保持高度竞争力的同时,实现更快、更轻量、更适合实际生产负载的目标。

总体而言,Ling-2.6-flash 围绕三大核心优势构建:

-

混合线性架构,提升推理效率。通过引入混合线性架构,我们在基础层面提升了计算效率。在 4× H20 配置下,Ling-2.6-flash 的推理速度可达每秒 340 个 Token。换言之,它以显著更优的性价比完成任务。

-

Token 效率优化,实现更优的智能-效率权衡。在训练过程中,我们专门针对 Token 效率进行了优化,目标是使用更简洁的输出来完成任务。在完整的人工分析(Artificial Analysis)评估套件中,Ling-2.6-flash 仅使用 1500 万个 Token,仍能提供具有竞争力的性能。这使其在智能-效率曲线上表现更为出色。

-

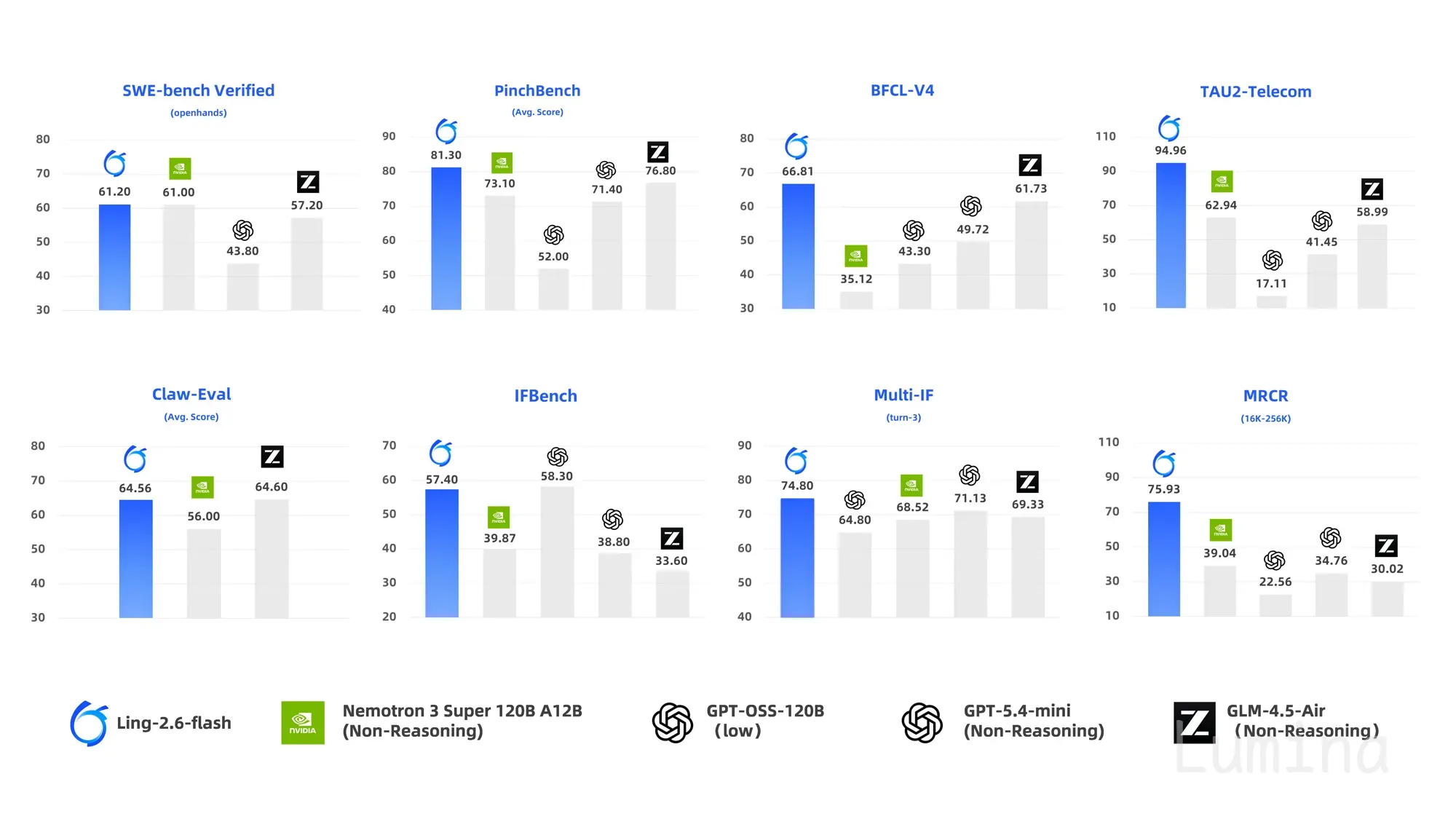

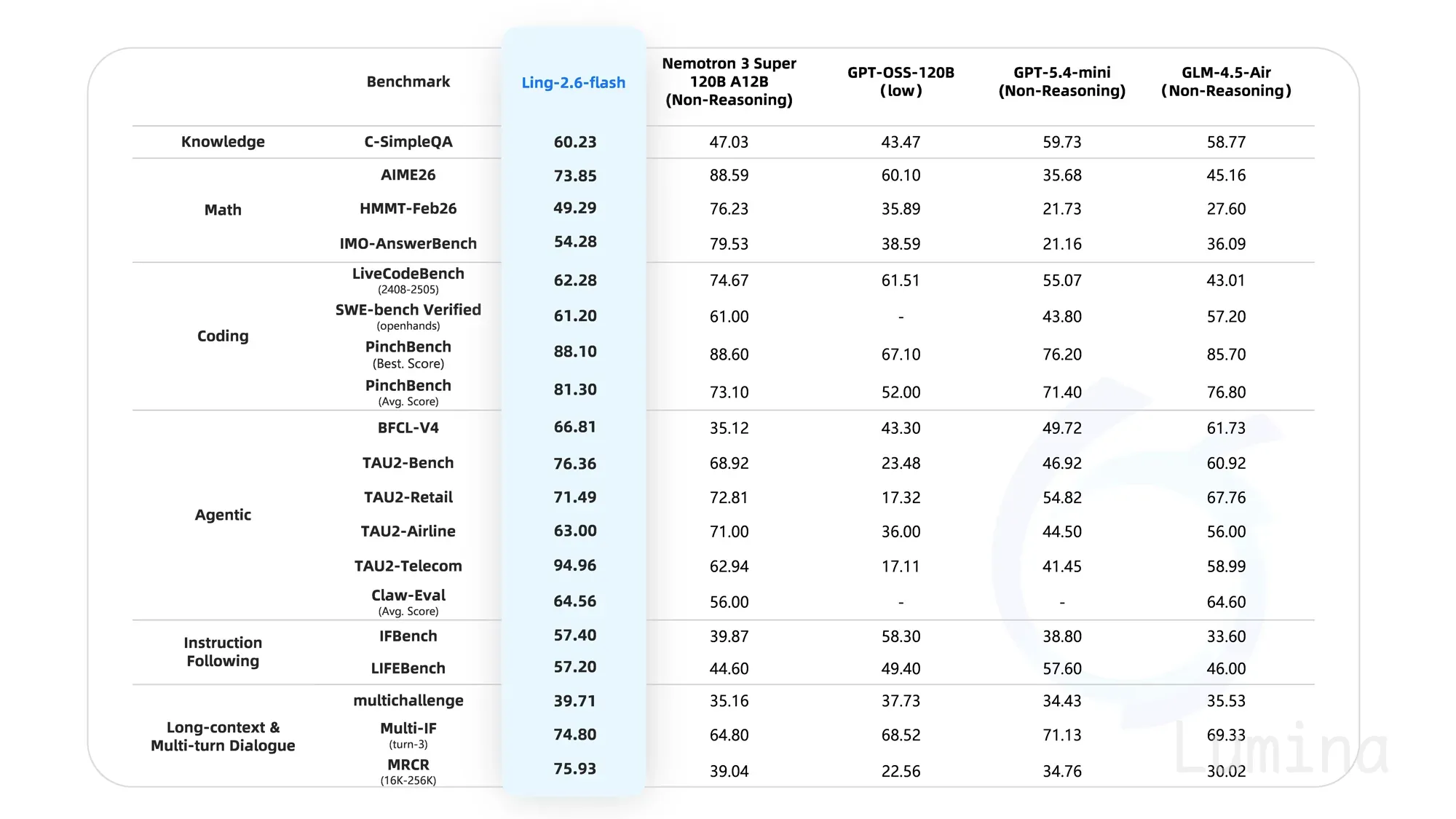

针对智能体场景的定向改进。针对当前需求最旺盛的智能体用例,我们持续优化 Ling-2.6-flash 在工具使用、多步规划和任务执行方面的能力。因此,该模型在包括 BFCL-V4、TAU2-bench、SWE-bench Verified、Claw-Eval 和 PinchBench 等基准测试中,性能可与激活参数量更大的模型相媲美,甚至在某些情况下达到 SOTA 水平。

评估

我们在多个权威基准测试中对 Ling-2.6-flash 进行了全面评估。Ling-2.6-flash 在具有代表性的智能体基准测试(如 BFCL-V4、TAU2-bench、SWE-bench Verified 和 PinchBench)中表现强劲。在实践中,Ling-2.6-flash 在包括 Claude Code、Kilo Code、Qwen Code、Hermes Agent 和 OpenClaw 等框架中均能提供出色的用户体验。

除了智能体任务,Ling-2.6-flash 在通用知识、数学推理、指令遵循和长上下文理解方面也表现出色,与同规模类别的 SOTA 模型保持良好对齐。

PinchBench:对比分数直接取自官方 PinchBench 排行榜(截至 2026 年 4 月 20 日),遵循其评估模式(可能为推理模式)。 Claw-Eval:对比分数来源于官方 Claw-Eval 排行榜(版本日期为 2026-03-25),遵循其评估模式(可能为推理模式)。目前 GPT-OSS-120B 和 GPT-5.4-mini 的官方分数暂不可用,故未列出。 TAU2-Bench:使用官方 v1.0.0 代码和数据集进行评估。遵循 GLM-5 评估协议,我们在零售和电信领域对提示进行了微调,以确保用户清晰表达请求并防止会话过早终止。此外,所有评估领域均使用 GPT-5.2 作为用户代理(User Agent)。 IFBench:GPT-OSS-120B(低)和 GPT-5.4-mini(非推理)的分数来源于 AA(人工分析)排行榜。所有其他模型性能数据均基于内部评估结果。

架构

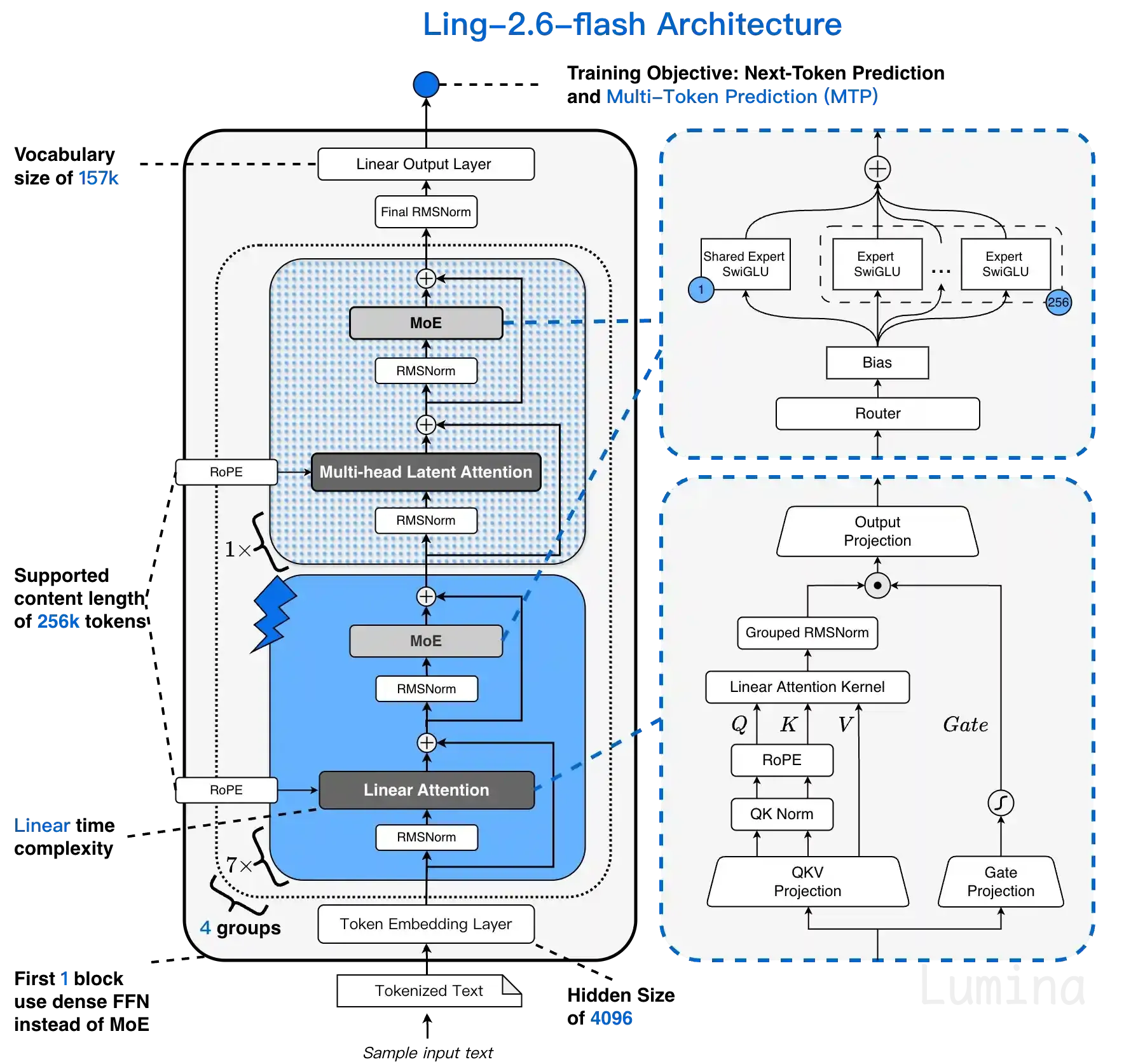

Ling-2.6-flash 延续了 Ling 2.5 引入的架构方向。在 Ling 2.0 的基础上,我们引入了混合线性注意力机制,通过增量训练将原有的 GQA 注意力设计升级为 1:7 MLA + Lightning 线性混合架构。

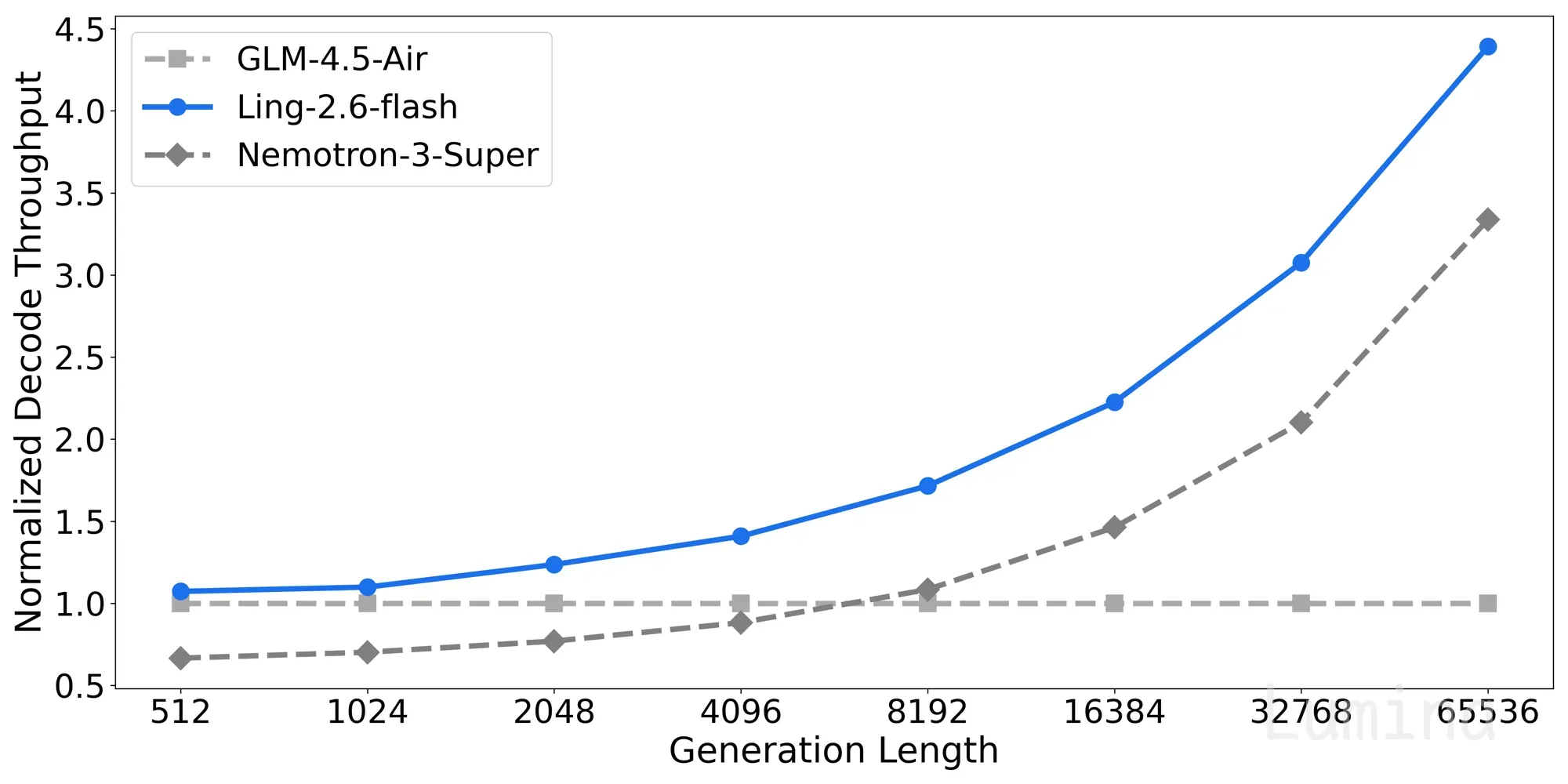

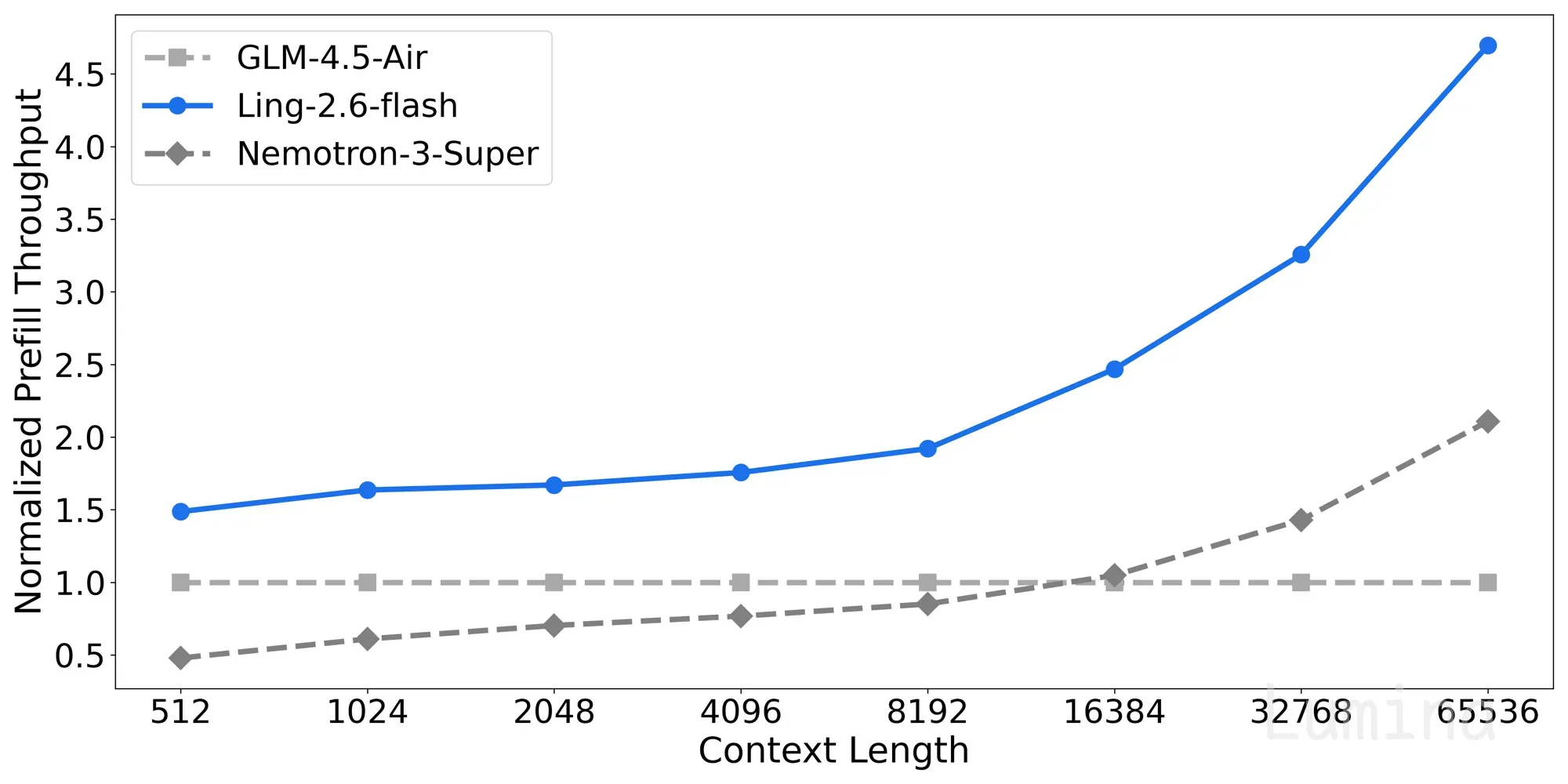

这种混合注意力与高度稀疏的 MoE 架构的结合,使 Ling-2.6-flash 在推理效率方面具有明显优势。与同规模类别的主流 SOTA 模型相比,Ling-2.6-flash 不仅实现了更快的首次 Token 响应时间,还在长输出场景中实现了显著更高的生成吞吐量。峰值时,**预填充吞吐量(prefill throughput)和解码吞吐量(decode throughput)**均可提升约 4 倍。

如下图所示,随着上下文长度和生成长度的增加,Ling-2.6-flash 的吞吐量优势愈发明显。更重要的是,这不仅是在静态指标上的基准测试优势。在实际部署环境中,随着任务复杂度的增长,模型持续释放出更强的速度优势。

无论是涉及长上下文理解还是扩展文本生成的工作负载,Ling-2.6-flash 都能在保持模型能力的同时,提供更快的响应、更高的吞吐量和更优的实际部署效率。

解码吞吐量对比,4× H20-3e,TP=4,批处理大小 = 32

预填充吞吐量对比,4× H20-3e,TP=4,批处理大小 = 32

快速入门

SGLang(推荐)

环境准备

pip install uv

uv venv ~/my_ling_env

source ~/my_ling_env/bin/activate

uv pip install "sglang[all]>=0.5.10.post1" --prerelease=allow

运行推理

目前 SGLang 支持 BF16 和 FP8 模型,具体取决于 ${MODEL_PATH} 中模型的 dtype。以下是使用 4 块 GPU 运行 Ling-2.6-flash 的示例,其中主节点 IP 为 ${MASTER_IP},服务器端口为 ${PORT}:

服务器

1. 标准推理(无 MTP)

python -m sglang.launch_server \

--model-path $MODEL_PATH \

--tp-size 4 \

--pp-size 1 \

--dp-size 1 \

--trust-remote-code \

--context-length 262144 \

--tool-call-parser qwen25 \

--json-model-override-args '{"rope_scaling": {"rope_type": "yarn", "factor": 2.0, "rope_theta": 6000000, "partial_rotary_factor": 0.5, "original_max_position_embeddings": 131072}}' \

--dist-init-addr $MASTER_IP :2345 \

--port $PORT \

--nnodes 1

2. 使用 MTP 的推理(多 Token 预测) 当前 SGLang 官方实现的 MTP 存在一个 bug。为了获得更好的推理性能,我们建议安装我们修补后的版本。我们的修复目前正在审核中,预计将很快合并到官方 SGLang 库中。

安装我们的 SGLang

git clone -b ling_2_6 [email protected]:antgroup/sglang.git

cd sglang

pip install --upgrade pip

pip install -e "python"

启动服务器

python -m sglang.launch_server \

--model-path $MODEL_PATH \

--tp-size 4 \

--pp-size 1 \

--dp-size 1 \

--context-length 262144 \

--mamba-scheduler-strategy extra_buffer \

--speculative-algorithm NEXTN \

--speculative-num-steps 3 \

--speculative-eagle-topk 1 \

--speculative-num-draft-tokens 4 \

--mem-fraction-static 0.75 \

--max-running-requests 64 \

--max-mamba-cache-size 256 \

--tool-call-parser qwen25 \

--json-model-override-args '{"rope_scaling": {"rope_type": "yarn", "factor": 2.0, "rope_theta": 6000000, "partial_rotary_factor": 0.5, "original_max_position_embeddings": 131072}}' \

--trust-remote-code \

--dist-init-addr $MASTER_IP :2345 \

--port $PORT \

--nnodes 1

客户端

curl -s http: // ${MASTER_IP} : ${PORT} /v1/chat/completions \

-H "Content-Type: application/json" \

-d '{"model": "auto", "messages": [{"role": "user", "content": "What is the capital of France?"}]}'

vLLM

环境准备

pip install uv

uv venv ~/my_ling_env

source ~/my_ling_env/bin/activate

git clone https://github.com/vllm-project/vllm.git

cd vllm

VLLM_USE_PRECOMPILED=1 uv pip install --editable . --torch-backend=auto

运行推理

服务器

vllm serve $MODEL_PATH \

--port $PORT \

--served-model-name my_model \

--trust-remote-code --tensor-parallel-size 4 \

--gpu-memory-utilization 0.85

客户端

curl -s http: // ${MASTER_IP} : ${PORT} /v1/chat/completions \

-H "Content-Type: application/json" \

-d '{"model": "auto", "messages": [{"role": "user", "content": "What is the capital of France?"}]}'

局限性与未来计划

Ling-2.6-flash 在我们追求极致智能-效率权衡的道路上已取得显著进展。该模型在工具使用、多步规划和长周期任务执行等关键领域实现了大幅提升。结合推理效率和交互体验的系统性优化,Ling-2.6-flash 现已能更好地处理大规模、高频次的自动化工作负载,在生产环境中提供更具价值的实际效益。

同时,我们充分意识到,将智能效率推向极限必然伴随权衡。在一些高度复杂的场景中,由于推理深度有限,模型仍可能出现工具幻觉(tool hallucinations)。此外,在中英文自然双语切换以及对高度复杂指令的合规性等方面,仍有改进空间。

展望未来,我们将继续探索智能效率的边界。在保持模型高效推理特性的同时,我们致力于进一步优化输出质量与Token 效率之间的平衡,并持续提升模型在更广泛实际场景中的稳定性、可用性和交互体验。