内容

ControlAI的使命是防范超级智能AI带来的灭绝风险。我们认为,要实现这一目标,必须确保国际社会禁止其发展。

我们正在通过我们认为是最自然且最有前景的方法来实现这一目标:帮助政府和公众决策者理解相关风险并采取行动。

我们相信,只要规模足够大,ControlAI就能促成国际社会对ASI(人工超级智能)发展的全面禁止。我们估计,每年约5000万美元的预算将为我们在未来几年内实现这一目标提供切实的机会。

在本文中,我们将阐述这一估算背后的部分推理,并解释超出该门槛的额外资金——包括5亿美元甚至更多——将如何继续显著提升我们通过ASI防止灭绝风险的可能性。

预防ASI入门

谈判、实施和执行一项关于ASI的国际禁令本身并非一家非营利组织的职责。要实现此类目标,必须有足够多国家支持。如果人类最终能够达成一项ASI国际禁令,那必然是通过一个动机充分、实力强大的初始国家联盟共同努力的结果。

假设我们在多个国家并行开展工作,我们可以将问题表述为:促使每个国家都有动力推动建立一项关于ASI的国际禁令。 “一个国家有动力”做某事的具体含义并不明显,因此值得花时间深入探讨。

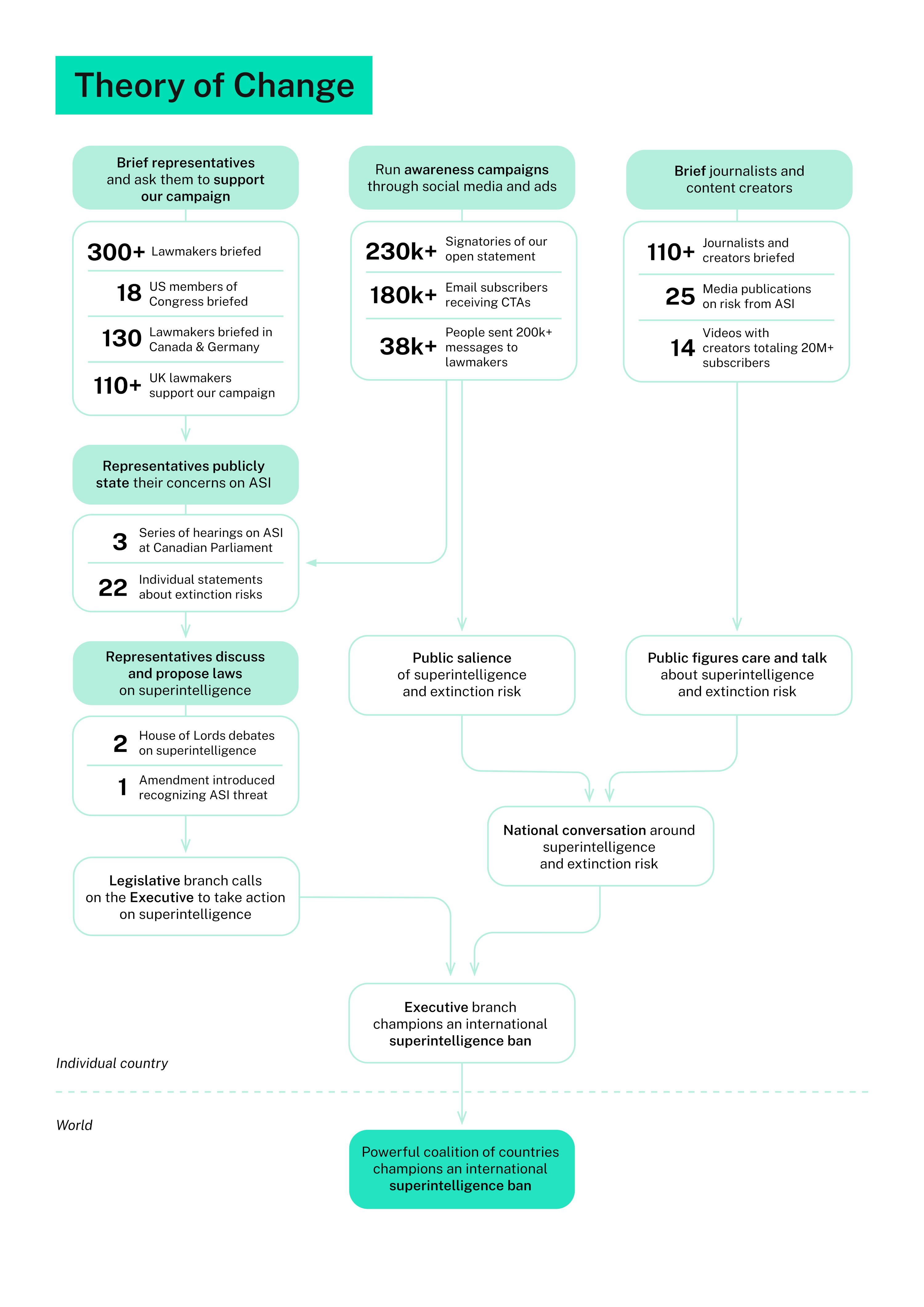

我们的完整变革理论图,从期望结果回溯至当前正在开展的工作流。

我们的完整变革理论图,从期望结果回溯至当前正在开展的工作流。

通常,一国的行政分支负责处理涉及国家安全和全球安全的紧急事务的国际谈判。实际上,正是这些群体需要具备足够的动力来推动禁令,并为之背书。

政府各部门通常不会独立采取大胆立场并将其贯彻到底;相反,它们的立场和行动主要受主流社会思潮的影响。

这些思潮中有些是非正式的,例如与同事、顾问、亲信或家人的对话,以及近期新闻周期和所接触的媒体内容。

另一些则通过更正式渠道运作,尤其是在民主国家。立法机构可以影响行政机构[1];公众则通过选举、民意调查、公共讨论和共同诉求施加影响(至少是因为这会影响未来选举结果的预期)。

当足够多的输入指向同一方向时,推动ASI国际禁令就可能成为该国首要任务之一。为此,我们需要全社会普遍意识到ASI带来的灭绝风险。 这句话包含两个完全必要的论点,因此让我们分别重复并展开说明。

论点一:灭绝风险的认知必须在整个社会中广泛普及。

禁止ASI的发展并非易事。它要求行政分支的相关部分采取大量主动行动,并做出许多艰难权衡。至少意味着将大幅放缓通用人工智能的进步速度,从而放弃经济和军事优势。如果某些国家最初不愿配合禁令,推动禁令者就需要动用昂贵的胡萝卜加大棒组合策略来说服他们加入。

要让相关群体承担这些成本,就必须让他们感觉存在巨大压力,而且这种压力来自四面八方。如果所有呼吁者都属于某个特定的小派系,就会引发强烈免疫反应,导致该派系被忽视,甚至在某些情况下遭到清洗。

论点二:这种认知必须具体针对超级智能AI带来的灭绝风险。

人们仅仅模糊地不喜欢AI,或仅模糊意识到AI带来某种可怕风险是不够的,有时甚至是有害的。由于前述的艰难权衡,各方会倾向于在各种层面采取半吊子措施,内外皆然。唯一足以对抗这种压力的力量,是对这样一个事实的理解:为了防止人类生存受到威胁,ASI的发展绝对必须被阻止。

若缺乏对这一具体问题的认知,就不可避免会导致行动软弱无力、政策松散且不聚焦,无法真正阻止ASI的发展。这也是我们为何在传播工作中只专注于ASI带来的灭绝风险,而不致力于提高人们对其他AI风险的认识,或试图让人们泛泛地反感所有AI的原因之一[2]。 [3]

认知是瓶颈所在

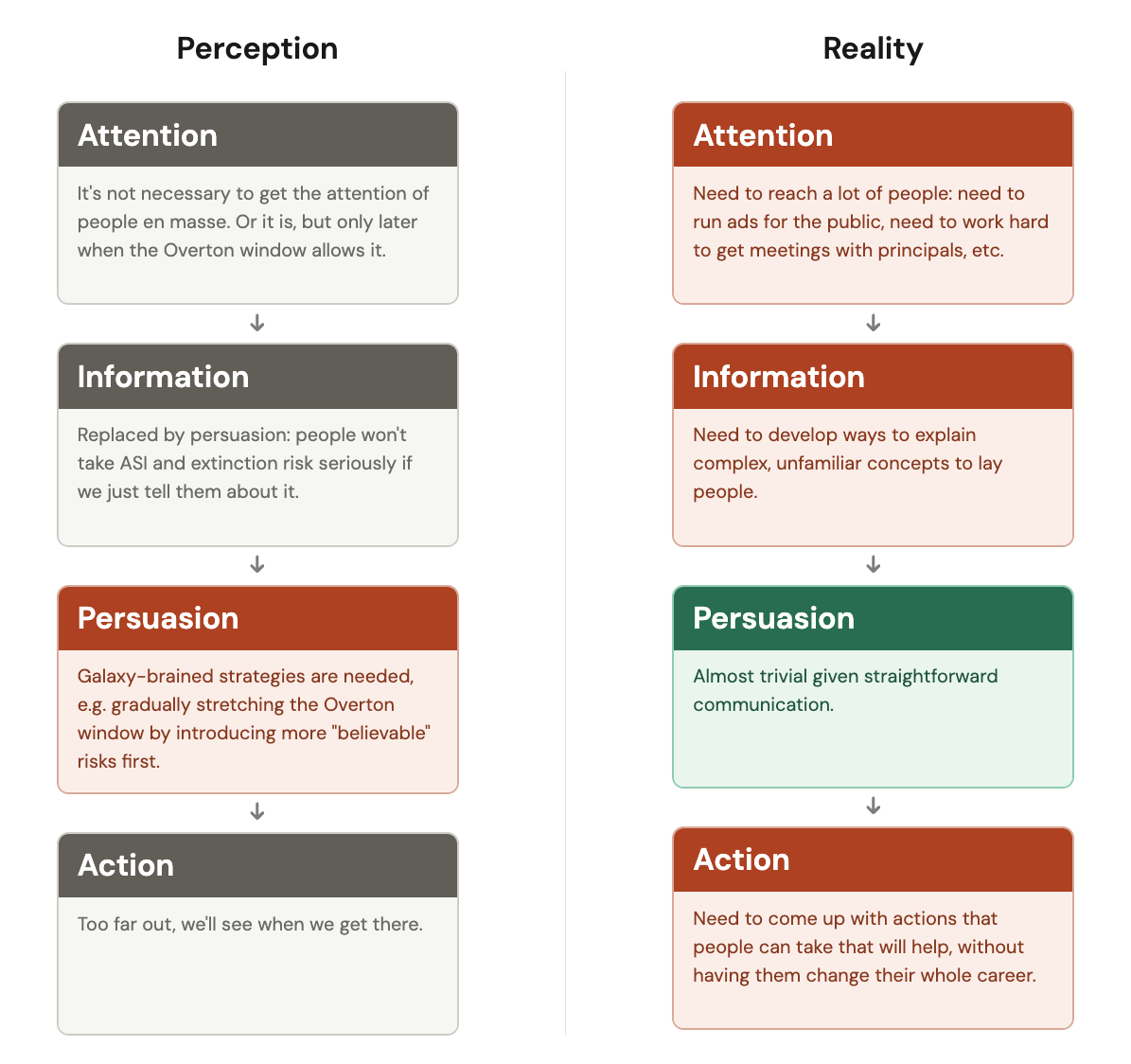

图表改编自Gabriel Alfour文章《AI安全社区的幽灵》(The Spectre haunting the “AI Safety” Community)中的“简单管道”一节。常见观点认为,无法直接向普通大众传达ASI的灭绝风险,因为他们永远不会理解。因此必须设计复杂的说服方案。但根据我们的经验,这种想法完全错误。只需讲真话即可!

图表改编自Gabriel Alfour文章《AI安全社区的幽灵》(The Spectre haunting the “AI Safety” Community)中的“简单管道”一节。常见观点认为,无法直接向普通大众传达ASI的灭绝风险,因为他们永远不会理解。因此必须设计复杂的说服方案。但根据我们的经验,这种想法完全错误。只需讲真话即可!

我们认为,获得超级智能国际禁令的主要障碍在于对该问题的基本认知。

例如,在我们接触到的立法者和媒体人中,绝大多数人从未以直白方式听说过这个问题。我们发现,往往只需要一次诚实的对话,就能让某人转变立场。诚实向人们解释担忧之所以如此容易实现,正是因为我们能在2025年取得如此多成果的原因[4]。

政客和公众根本不知道AI领域最重要的人物确实担心超级智能导致人类灭绝。他们也不知道,专家能真正达成共识的唯一避免人类灭绝的方式,从一开始就不建造ASI。

他们之所以不了解这一点,是因为没人告诉他们,而不是因为他们不理解相关概念。根据我们的经验,大多数人都能直观地理解:建造像ASI这样强大、不可预测且无法理解的事物极其危险;无法控制ASI;它极易引发灾难性场景;这意味着你根本不应该一开始就建造它。

人们之所以不了解超级智能带来的灭绝风险,简而言之,是因为持关切的专家们通常没有坦率表达自己的担忧。《AI风险CAIS声明》[5]是一个罕见例外,但它已经过时,即使如此仍远远不够。

我们已经与立法者会面超过300次。大多数时候,他们之前从未有人向他们解释过灭绝风险,也从未听说过CAIS声明——直到会议时才第一次听说。

即便如此,政客们也不关心一个人是否签署过一次声明。那不是他们认为一个真正担忧整个人类种族灭绝的人应有的行为方式。在他们听来,这听起来很弱,甚至像是假的。

在一个严肃的世界里,你本应期待每一位担心灭绝的AI专家都大声而一致地公开表达他们的担忧,包括向公众和政府决策者发声。然而现实并非如此。AI公司及其领导者不断淡化他们的言论,避免明确提及灭绝风险,更喜欢谈论委婉语或其他风险。Anthropic的增长主管最近表示,Anthropic不断调整沟通方式,使其“更温和”,显得“不那么极端”。

当美国参议员询问Sam Altman,他在博客文章中说“机器智能超越人类很可能是对人类持续存在的最大威胁”时,是否考虑过就业问题时,他没有纠正参议员,而是转而谈论AI对就业的可能影响。

如果你有机会参加湾区的一场家庭聚会,你会对此有更深刻的体会:许多AI公司的研究人员确实担心灭绝风险,并将自己的生活围绕这一关切进行调整。然而,他们却不在公开场合谈论这些风险。

对我们而言,显而易见的是,在ASI国际协议方面进展甚微的原因,正是专家未能一贯坦诚地表达他们的担忧。

一场非对称战争

虽然一项关于ASI的国际禁令显然是一个非常雄心勃勃的目标,但从根本上说,倡导ASI带来的灭绝风险意味着占据上风。这是因为几乎没有人愿意死于ASI。

政治通常是不同利益集团之间对抗性的拉锯战。在美国政治中涉及高调议题时(例如堕胎、大麻合法化、Prop 22),往往需要投入数亿美元[6]。

然而,在灭绝风险问题上,不同利益集团之间几乎没有冲突。如果灭绝真的发生,所有人都将死亡,无论其财富、政治派别或其他个人利益如何。只有极少数人在认真考虑灭绝困境后,仍然决定赌上人类灭绝的风险去换取ASI。

这在分形层面上同样成立。这不仅意味着我们预计该议题在国内是非党派的,还意味着只要存在重大风险——即建造超级智能可能导致人类灭绝——各国之间的利益也将趋于一致[7]。这就是为什么我们认为,如果我们能以更大规模复制已取得的成功,就有很大机会促成超级智能的国际禁令。

由于我们的方法不是通过纯粹的实力赢得政治拉锯战,我们预计即使预算低至5000万美元(至少比其它重大议题的政治运动小一个数量级),仍有约10%的成功概率[8]。我们认为“良好机会”(约30%)则需要5亿美元级别的预算[9]。

让我们进一步说明“政治拉锯战”的含义。一种常见策略,尤其是试图阻止某项法律通过时,是故意混淆视听——例如只大力宣传己方提案的好处,或只强调反对者的弊端,或通过人身攻击削弱对方信誉。

除了这种策略明显的道德问题外,在面对像ASI灭绝风险这样清晰明确、关乎全人类的问题时,它们的效果会大打折扣。对于灭绝风险这类议题,更难挑动对立或执行混淆战术来阻碍建立限制的努力。

可扩展的流程

从根本上说,ControlAI是一项旨在创建可扩展、工业化方法来防范ASI灭绝风险的努力。 AI风险缓解领域历史上依赖我们称之为“定制”或“ artisan”(工匠式)的方法,即依靠杰出个体通过遵循个人品味实现特定成功,例如出版一本畅销书,或通过出色的社交能力达成惊人成就。

这些“工匠式”工作流的“成功”标准并未成文规定,也很少有人努力去定义和夯实它。对大多数关注AI风险的人来说,判断自己是否成功更像是一种主观感受,而非量化衡量,容易陷入 galaxy-brain 陷阱。成败很大程度上取决于个人的品味质量,最差则纯属运气。

即使在这些努力中取得成功,你也难以轻易复制同样的成果。为了更清楚地说明我们的意思:Eliezer Yudkowsky 和 Nate Soares 无法通过简单地投入更多资源到相同努力中来轻易复制他们因出版《If Anyone Builds It, Everyone Dies》一书而取得的成功,更不用说围绕该方法建立一个组织来扩大其影响力了。这本书非常出色,有助于传播意识,但你不可能每周都出一本书。

类似地,CAIS《AI风险声明》在建立共同知识方面表现出色,极大助力了我们的工作。尽管如此,这类工作很难复制,事实上至今尚未被复制:无论是CAIS还是任何其他组织,都未能让顶级AI公司的所有CEO签署一份同样坦率的声明[10]。

**ControlAI采取不同的方法,一旦设定好工作流,就能直接扩展其规模。**每当我们有一个过于遥远而无法直接应对的目标时,我们会将其分解为最 ambitious 可能的中间目标,并认为我们可以采取行动。关键在于,我们选择的中间目标可以用硬数字衡量进展。这样我们就近似于销售漏斗——这是企业处理销售的黄金标准。

以下是应用此方法的一些例子。我们早期面临的一个挑战是如何将成功的议员简报制度化,使其随时间积累势头。我们的解决方案是创建一个campaign statement[11],并要求议员公开支持它。我们已经获得了120名这样的支持者!

这个解决方案满足几个重要约束条件:

-

它将世界推向一个更容易实现我们对ASI国际禁令总体目标的状态:每位公开支持者都通过创造共同知识来帮助我们,即议员认为这是一个迫切需要立即关注的紧迫问题。

-

它为这项工作流提供了明确、数值化的成功衡量标准:签署我们竞选声明的议员人数。

-

我们可以直接应对这一挑战:每次简报结束时,只需请议员公开支持该竞选活动即可。

-

边际投入会随时间叠加:每位额外议员公开支持该竞选活动都会增强该议题的可信度,并使未来更多议员更容易就此表态。

一段时间后,我们准备推进更具雄心的目标。因此,在继续增加支持竞选活动的议员数量的同时,我们引入了一个新的指标:由个别议员撰写或发表的公开声明数量[12],明确提及AI灭绝风险或防止超级智能,前提是这些声明是在我们亲自简报之后发生的。目前在英国,这一指标为21个。

这些指标是数字化的且定义清晰,意味着即使是新入职的毕业生也可以被指派去做“让它上升”或改善漏斗各步骤之间的转化率。不会有任何人误以为自己取得了多大进展的风险[13]。

事实上,大多数合理聪明且有动力的员工,在获得适当指导的情况下,自然会迭代自己的方法并最终取得良好成果。这样,我们就不必一开始就幸运地雇佣到拥有不可思议品味的人才。

这一主张最有力的证明是我们