内容

昨晚,我再次在路演之夜被拒绝了。这甚至只是预面试环节,问题也不在于我的产品本身——我已经有了月度经常性收入(MRR),用户每天也都在依赖它运行。

但反馈却很简单:“你到底需要融资做什么?”

当我试图发展自己的创意时,这句话我听过太多次了。精益运营已经刻在我的基因里了。你可能用过我开发的工具,比如 websequencediagrams.com;也可能没听说过那些小众产品,比如 eh-trade.ca。这种对效率的执着,反而让我成功实现了自力更生,说真的,很多风投机构 讨厌 这一点。

把成本压到接近零,和烧掉一百万美元资金相比,其实能给你完全一样的跑道时间。压力更小,架构极其简单,而且不用承受董事会天天盯着你的巨大压力,你有足够的时间去找到产品的市场契合点。

如果你厌倦了如今那种臃肿的企业级模板,下面就是我如何用最少的资源搭建公司的完整策略。

使用精简服务器

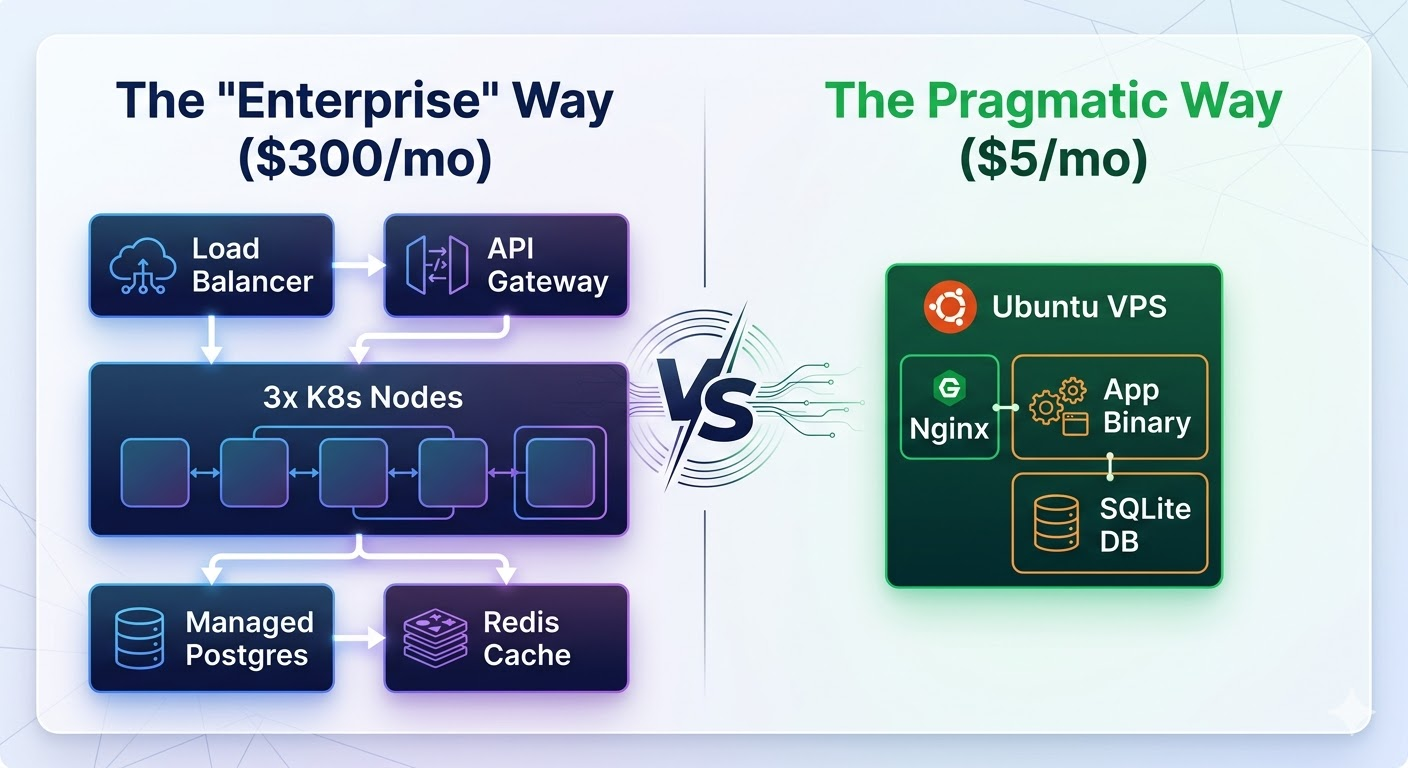

2026年启动一个网页应用的 naive 方式,就是直接开 AWS,部署 EKS 集群,配置 RDS 实例,设置 NAT Gateway,结果还没等用户点开落地页,每个月就莫名其妙花掉300美元。

聪明的方式是租一台虚拟专用服务器(VPS)。

我首先会选一台便宜又可靠的机器。忘掉 AWS吧,你根本用不着它,他们的控制面板就是个迷宫,专门诱导你升级账单套餐。我用的是 Linode 或 DigitalOcean,每月最多付5到10美元就行。

对现代 Web 开发者来说,1GB 内存听起来很吓人,但只要你清楚自己在做什么,这点内存完全够用。如果需要更多空间,可以加个 swapfile。

目标不是维护基础设施,而是响应请求。当你只有一台服务器时,日志在哪、为什么会崩溃、怎么重启,这些事你都一清二楚。

使用精简语言

现在你有了约束条件——只有1GB内存。理论上你可以用 Python 或 Ruby 做后端主语言,但何必呢?光是启动解释器和管理 gunicorn worker 就会吃掉你一半内存。

我用 Go 写后端。

Go 在处理网络任务上性能远超其他语言,类型严格,而且——对2026年的开发者来说最关键的是——LLM 理解起来非常容易。不过 Go 真正的魔力在于部署过程:没有 pip install 那样的依赖地狱,也没有虚拟环境。你直接在笔记本上把整个应用编译成一个静态链接的二进制文件,然后 scp 到那台5美元的服务器上,直接运行就行。

下面是一个完整的、生产就绪的 Go Web 服务器示例,不需要任何臃肿框架:

package main

import (

"fmt"

"net/http"

)

func main() {

http.HandleFunc("/", func(w http.ResponseWriter, r *http.Request) {

fmt.Fprintf(w, "Hello, your MRR is safe here.")

})

// 这个程序在普通电脑上也能轻松处理每秒上万次请求

http.ListenAndServe(":8080", nil)

}

用本地 AI 处理长时间运行的任务

如果你家里有一张显卡,那你其实已经有 无限 的 AI 算力了。

我在开发 eh-trade.ca 时遇到过一个问题:需要对数千家公司进行深度定性股市研究,还要总结海量的季度报告。 naive 的做法是把所有数据扔给 OpenAI API,可能得花几百美元买 API 额度,结果却发现提示词循环里有逻辑 bug,还得重新跑一遍全部数据。

后来我干脆在 Facebook Marketplace 上淘了一张二手的900美元显卡(RTX 3090,24GB显存),在上面跑 VLLM。虽然前期投入大一点,但从那以后我再也不用为批量处理支付任何费用给 AI 提供商了。

对于本地 AI,你可以按以下路径升级:

-

从 Ollama 开始。一条命令就能搞定(

ollama run qwen3:32b),瞬间试用几十个模型,非常适合快速迭代提示词。 -

生产环境切换到 VLLM。一旦系统跑通了,Ollama 就成了并发请求的瓶颈。VLLM 会把 GPU 锁定在一个模型上,但因为用了 PagedAttention 技术,速度要快得多。把你的系统设计成同时发送8或16个异步请求,VLLM 会在显存里把它们打包处理,16个请求基本能在处理一个请求的时间内全部完成。

-

更复杂的场景就用 Transformer Lab。如果你需要做模型预训练或微调,Transformer Lab 能让本地硬件轻松胜任。

为了统一管理这些,我开发了 laconic——一个专为受限8K上下文窗口优化的智能体研究员。它像操作系统的虚拟内存管理器一样管理 LLM 上下文,把无关信息“分页”出去,只保留最关键的知识点在活跃窗口中。

我还用 llmhub,它能把所有 LLM 抽象成统一的 provider/endpoint/apikey 组合,无论模型是在你桌下运行还是在云端,都能优雅地处理文本和图片输入输出。

用 OpenRouter 对接高速/智能 LLM

不可能所有事情都靠本地完成。有时候你需要 Claude 或 ChatGPT 的最前沿推理能力,来处理用户端低延迟的聊天交互。

与其分别管理 Anthropic、Google 和 OpenAI 的账单账户、API 密钥和速率限制,我直接用 OpenRouter。你在代码里写一套兼容 OpenAI 的接口,就能立刻访问所有主流前沿模型。

更重要的是,它支持无缝降级路由。如果周二下午 Anthropic 的 API 挂了(这种事经常发生),我的应用会自动切换到等效的 OpenAI 模型,用户根本看不到错误页面,我也无需编写复杂的重试逻辑。

用 Copilot 替代炒作 AI IDE

每周都有新的、贵得离谱的大模型发布。我总听到开发者们每月花几百美元订阅 Cursor,再买 Anthropic API 密钥,就为了 AI 帮他们写模板代码。

而我整天用 Claude Opus 4.6,月费 barely 才60美元。秘诀是什么?我利用了微软的定价模式。

2023年我买了 GitHub Copilot 订阅,装进标准 VS Code,从此没再换过。Cursor 和其他 fancy 分支刚出来时一度领先,但 Copilot Chat 总能追上来。

你可能没注意到的小 trick:微软居然按请求收费,而不是按 token 计费。“请求”就是你往聊天框里敲的东西。哪怕 agent 接下来半小时都在啃你的整个代码库、分析依赖关系、修改数百个文件,我也只要付大约0.04美元。

最优策略很简单:写极度详细的提示词,设定严格的成功标准(本来就是最佳实践),告诉 agent “继续执行直到所有错误修复完毕”,回车,然后去泡杯咖啡——Satya Nadella 已经在帮你补贴计算成本了。

全栈都用 SQLite

每次启动新项目,我都会先用 sqlite3 作为主数据库。别急着否定,这比你想象中靠谱多了。

企业思维总认为你得用外部进程数据库服务器。但真相是,通过 C 接口或内存通信的本地 SQLite 文件,比通过网络跳板连接远程 Postgres 服务器要快好几个数量级。

“可那并发怎么办?”你可能会问。很多人以为 SQLite 每次写入都会锁住整个数据库,这是错的。你只需要开启预写日志(WAL)模式。打开数据库时执行一次:

PRAGMA journal_mode=WAL;

PRAGMA synchronous=NORMAL;

搞定!读者不再阻塞写操作,写操作也不再阻塞读者。现在你甚至可以用单个 .db 文件在 NVMe 硬盘上轻松支撑上千并发用户。

由于用户认证通常是基于 SQLite 项目中最烦人的部分,我开发了一个库:smhanov/auth。它直接集成到你正在用的数据库,管理用户注册、会话和密码重置,还支持 Google、Facebook、X 登录,甚至公司专属 SAML 提供商。没有臃肿依赖,只有简洁、可审计的代码。

结语

科技行业总想让你相信,做真生意就得搞复杂编排、每月烧几万 AWS 账单,还得融几百万风险投资。

其实根本不用。

只要用一台 VPS、静态编译的二进制文件、本地 GPU 硬件处理批量 AI 任务,再加上 SQLite 的极致速度,你就能以一杯咖啡的价格启动一个高度可扩展的初创公司。这相当于给你的项目加了无限跑道,让你有充足时间去真正解决用户问题,而不是天天担心烧钱速度。

如果你也想 lean 运营,不妨看看我在 GitHub 上的 auth 库和智能体实现:https://github.com/smhanov。评论区见,聊聊你怎么压低服务器成本,或者告诉我哪里我完全错了。