Andrej Karpathy 作者

浏览作者 Andrej Karpathy 的公开文章、摘要与延伸阅读。肖恩子的知识花园

全部

发表时间倒序

全部来源

Andrej Karpathy

作者:Andrej Karpathy排序:发表时间倒序

英文

英文4

Andrej Karpathy 使用 LLM 构建个人知识库流程

佳文共赏

LLM问答Markdown+3

作者: Andrej Karpathy

发表时间:

作者用LLM把论文、文章、仓库和图片等原始资料持续编译成由Markdown构成的个人知识库,并在Obsidian中查看与管理,LLM负责摘要、分类、链接、问答、可视化和数据校验,用户几乎不手动编辑;在中小规模下无需复杂RAG也能高效检索与研究,且查询结果会反哺知识库,最终指向可产品化的知识操作系统。

英文

英文12

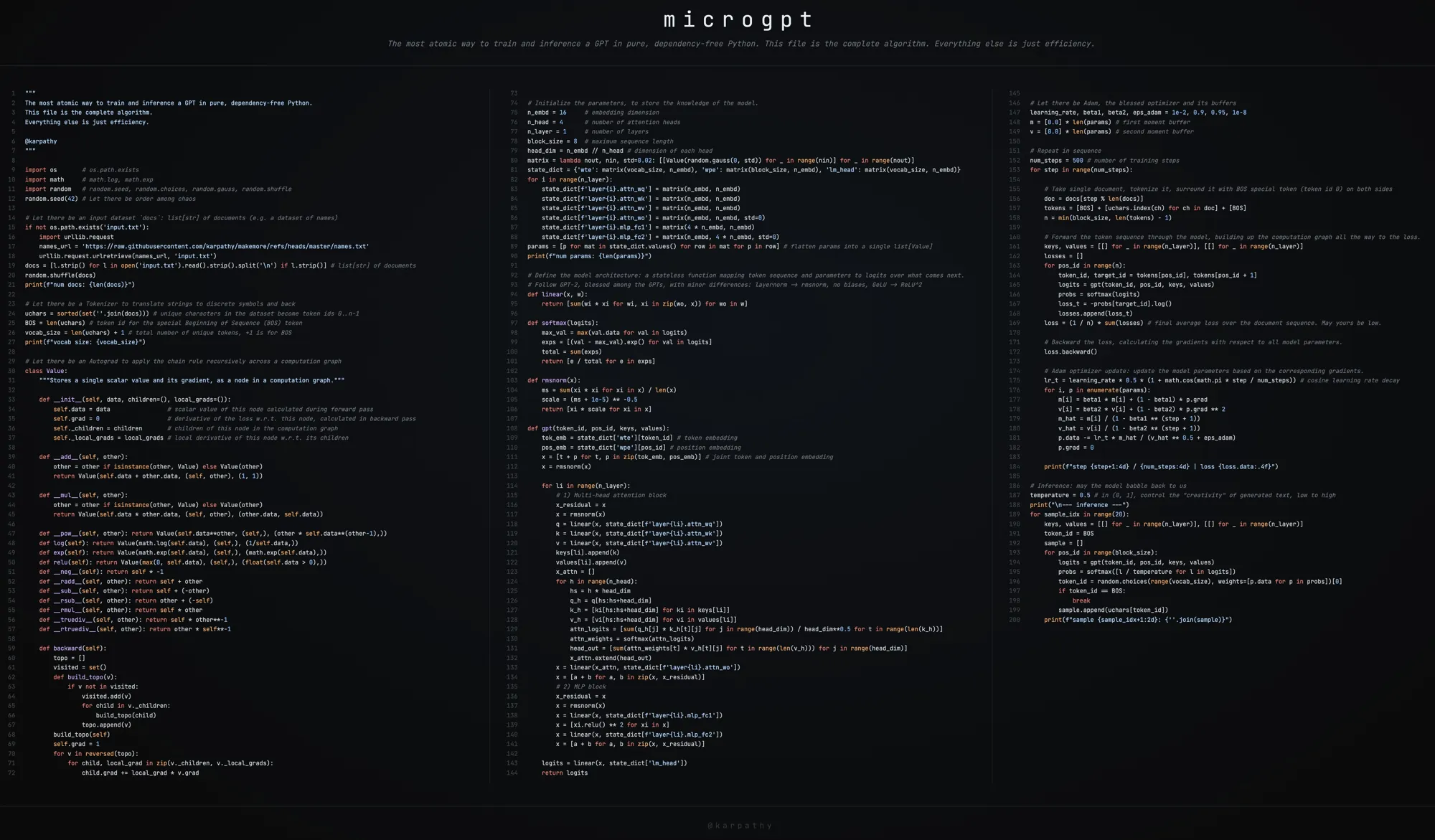

microgpt: 一个最小化的 GPT 实现

开源项目

作者: Andrej Karpathy

发表时间:

microgpt以200行无依赖Python把数据集、字符级分词、自写autograd、类GPT-2网络、Adam训练与采样推理压进单文件,在3.2万姓名上训练1000步使loss约3.3降至2.37并生成新名字,结论是GPT训练与生成的算法本质可被极简复现,生产差异主要在规模与工程效率。

英文

英文10

人工智能改变了编程的面貌

业界资讯

作者: Andrej Karpathy

发表时间:

作者称自去年12月起AI编码代理从几乎不可用跃迁为可独立推进长任务,示例中其在约30分钟内完成环境部署、模型下载测试、服务与界面搭建并提交报告,结果编程从手写代码转向用自然语言指派并行代理并审核,工程师重心变为拆解、判断与编排,开发流程被显著重塑但仍需监督且更适合可验证任务。

英文

英文4

2025 年大语言模型年度回顾

佳文共赏

作者: Andrej Karpathy

发表时间:

2025年LLM进展由RLVR取代部分预训练、以可验证奖励拉长推理驱动能力提升,模型呈“尖峰式”智能并使基准易被针对而失真,同时Cursor推动编排型应用层、Claude Code确立本地私有环境代理形态,vibe coding降低编程门槛且重塑岗位,Gemini“nano banana”提示多模态GUI方向,结论是能力仍将加速但离AGI尚远且潜力未被充分开发。

每页显示条,共 5 条

10

上一页第 1 / 1 页下一页