英文

英文你的人工智能并非“笨拙”—— 它只是需要更出色的驾驭方式

智能体失效的主因不是模型能力不足,而是缺少明确的系统外壳,可靠方案是用Harness Engineering把模型置于受控执行层中,通过约束行为、外置状态、逐步校验和局部恢复,配合工具截断、模式验证、状态管理、编排与重试机制,避免长流程中的幻觉、格式漂移和整体崩溃。生产级AI竞争力取决于系统设计而非提示技巧。

浏览 技术博客 分类下的公开文章、摘要与延伸阅读。肖恩子的知识花园

英文

英文智能体失效的主因不是模型能力不足,而是缺少明确的系统外壳,可靠方案是用Harness Engineering把模型置于受控执行层中,通过约束行为、外置状态、逐步校验和局部恢复,配合工具截断、模式验证、状态管理、编排与重试机制,避免长流程中的幻觉、格式漂移和整体崩溃。生产级AI竞争力取决于系统设计而非提示技巧。

英文

英文多数企业只是把AI嵌入原流程,效率仅小幅提升;真正的AI-first是围绕“AI主建、人类监督”重构产品、研发、测试与组织,并统一代码架构与自动化反馈闭环。作者团队借此把发布频率提升到日更级,缩短从想法到上线的周期,同时提高质量与转化,可见竞争力来自流程重构而非单点用AI。

英文

英文AI 编码代理读取文档依赖可发现性、可解析性、上下文 token 成本和访问权限,传统面向人类的页面分析几乎捕捉不到其行为;若文档过长、结构差或被 robots.txt 阻挡,代理会跳过、截断或幻觉生成。解决方案是做 AEO:提供 llms.txt、skill.md、AGENTS.md、Markdown 源、token 标注并监测 AI 流量,以提升代理调用成功率与文档实际可用性。

英文

英文多智能体协作应先选最简单可行方案,再按瓶颈演进:质量可显式校验用生成者—验证者,任务可清晰拆分用编排者—子代理,长期并行且相互独立用代理团队,事件驱动且生态扩张用消息总线,需要实时共享发现、避免单点故障用共享状态;关键在于任务依赖、上下文持续性与信息流方式是否匹配。

英文

英文Anthropic推出Managed Agents,将长时代理拆成会话、编排器和沙箱三层接口并彻底解耦,使组件可独立替换、崩溃恢复和跨环境连接,同时把凭证隔离在沙箱外、将上下文持久化到会话日志而非模型窗口。让安全性、可调试性、扩展性显著提升,首字延迟大幅下降,并能适配未来更强模型与多代理协作。

英文

英文Agent应用的十大风险几乎都可归结为包管理供应链问题,核心路径包括名称混淆、注册表与元数据投毒、依赖解析篡改、安装或导入时执行恶意代码、插件自动加载与凭证窃取;由于代理会自动发现、安装、执行并传播依赖,且权限更高、缺少人工复核,传统包管理漏洞被放大为更快扩散、更难察觉的系统性失陷。

英文

英文核心是配置 Hysteria2 与 Clash 客户端直连运行:Cloudflare 子域名解析到 VPS,必须关闭代理改为 DNS Only,否则 QUIC 不可用;服务端监听 443,填写子域名、邮箱和强密码;客户端同步相同域名与密码到 proxy.yaml,最终实现基于 QUIC 的 HY2 节点接入与分流使用。

英文

英文智能体能力主要取决于包裹LLM的“agent harness”,而非模型本身;其核心是编排循环、工具调用、记忆、上下文管理、状态持久化、错误处理、安全护栏、验证与多智能体协作,把无状态模型变成可执行系统。生产级效果差异往往来自harness设计,优秀方向是用更薄但更稳的基础设施提升性能。

英文

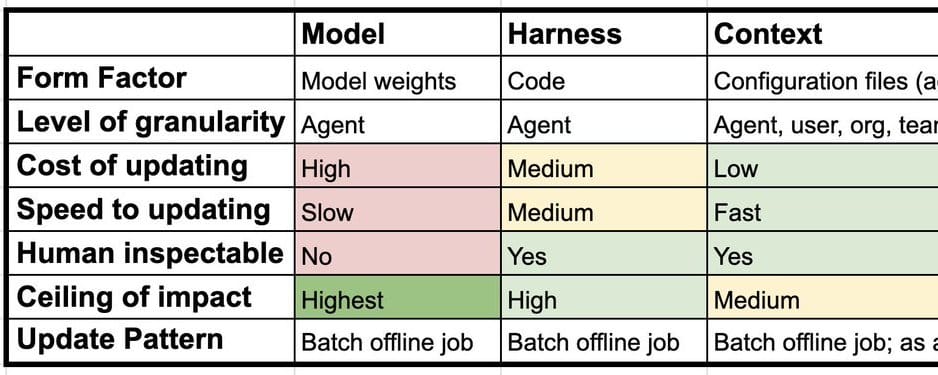

英文AI智能体的持续学习不只发生在模型权重,还包括驱动代理的harness和可配置的context,三层都能基于执行轨迹持续更新;模型更新面临灾难性遗忘,harness可通过分析任务日志迭代代码,context可在代理、用户或组织层离线或实时写入记忆;构建会长期变强的智能体,关键不只是训模型,而是用轨迹统筹优化三层。

英文

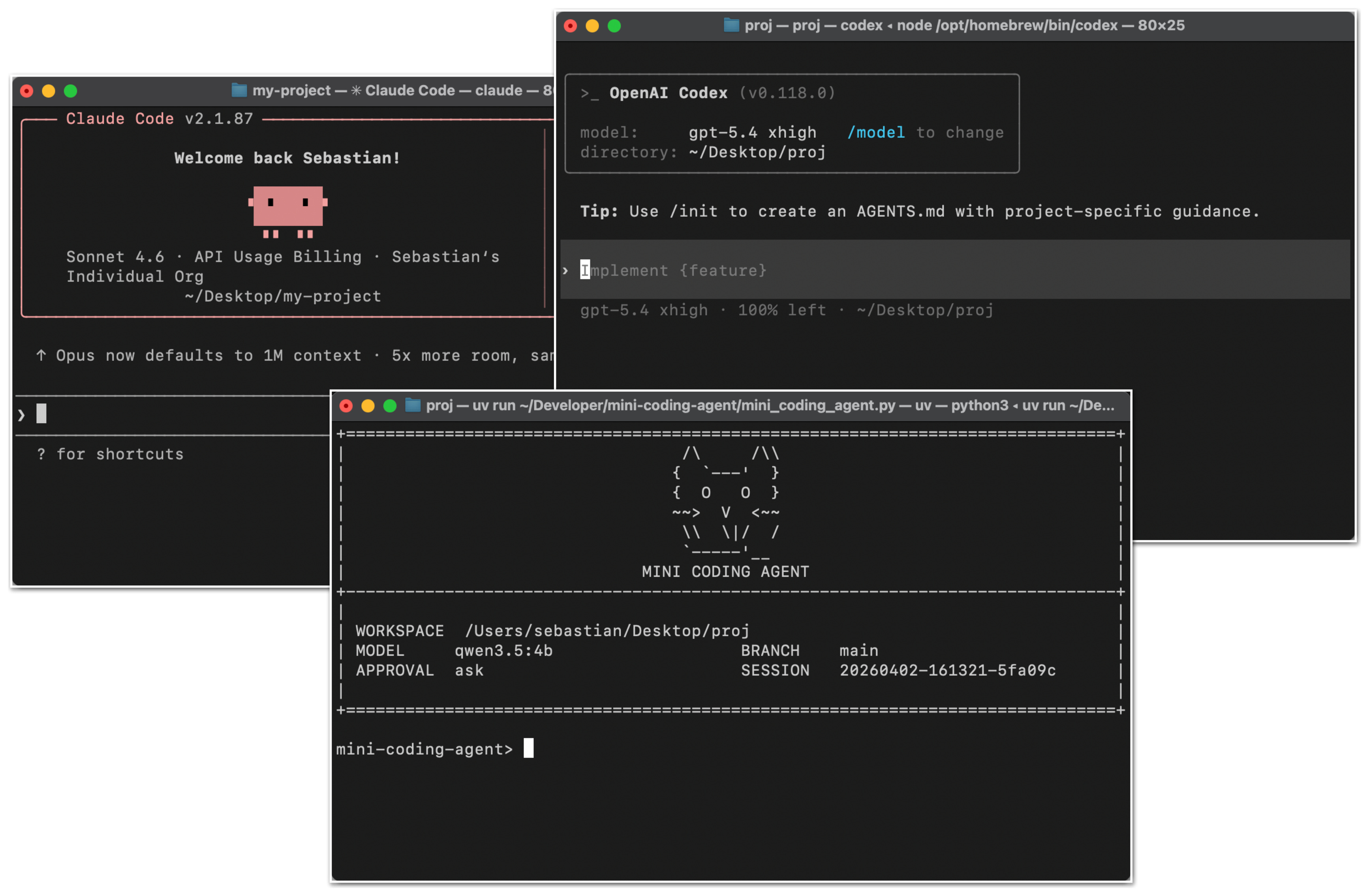

英文编码代理的核心不在模型本身,而在其外层执行框架:通过实时仓库上下文、可复用提示缓存、受控工具调用、上下文压缩、结构化会话记忆和有边界的子代理协作,让LLM在代码检索、修改、测试和多轮连续任务中更高效、更可靠;因此优秀的coding harness往往比单纯更强的模型更能决定实际编码表现。